Init

This commit is contained in:

110

03-UnrealEngine/卡通渲染相关资料/Toon 眼睛反射与视差效果.md

Normal file

110

03-UnrealEngine/卡通渲染相关资料/Toon 眼睛反射与视差效果.md

Normal file

@@ -0,0 +1,110 @@

|

||||

## PBR Refrection(有问题)

|

||||

```

|

||||

//input anteriorChamberDepth 贴图 使用HeightMap

|

||||

//input radius

|

||||

//input mask 贴图

|

||||

//input texcoord

|

||||

//input n 折射率比值

|

||||

//input frontNormalW 贴图float3(0,0,1) Local=>World

|

||||

|

||||

// 角膜区域突起的模型 height = max(-positionL.z – eyeIrisDepth, 0.0);

|

||||

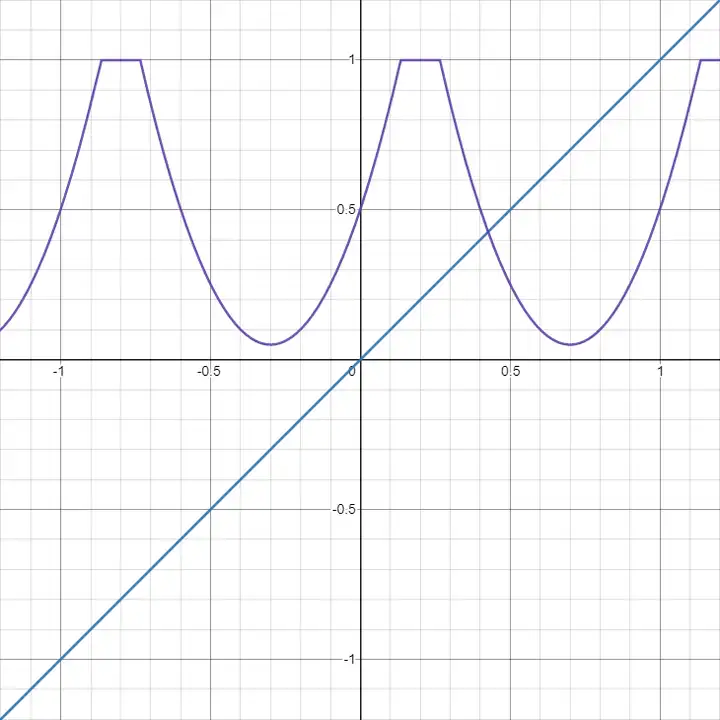

// 球形模型 Plot[Max[1.0 - 18.4 * r * r, 0.0], {r, 0, 0.3}]

|

||||

float height = anteriorChamberDepth ;//* saturate( 1.0 - 18.4 * radius * radius );

|

||||

|

||||

float3 normalW=Parameters.WorldNormal;

|

||||

float3 viewW= mul(float3(0,0,1),(float3x3)View.ViewToTranslatedWorld);//CameraViewToTranslatedWorld

|

||||

|

||||

// refractedW

|

||||

float w = n * dot( normalW, viewW );

|

||||

float k = sqrt( 1.0 + ( w - n ) * ( w + n ) );

|

||||

float3 refractedW = ( w - k ) * normalW - n * viewW;

|

||||

refractedW=-normalize(refractedW);

|

||||

|

||||

//float3 frontNormalW=mul(float(0,0,1),float(3x3)GetPrimitiveData(Parameters.PrimitiveId).LocalToWorld) * -1;

|

||||

float cosAlpha = dot(frontNormalW, refractedW);

|

||||

float dist = height / cosAlpha;

|

||||

float3 offsetW = dist * refractedW;

|

||||

float2 offsetL = mul(offsetW, (float3x2)GetPrimitiveData(Parameters.PrimitiveId).WorldToLocal);

|

||||

texcoord += float2(mask, -mask) * offsetL;

|

||||

|

||||

return texcoord;

|

||||

```

|

||||

### 原始代码

|

||||

```

|

||||

// 角膜区域突起的模型

|

||||

// Alternatively, use a displacement map

|

||||

// height = max(-positionL.z – eyeIrisDepth, 0.0);

|

||||

|

||||

// 球形模型

|

||||

// Plot[Max[1.0 - 18.4 * r * r, 0.0], {r, 0, 0.3}]

|

||||

height = anteriorChamberDepth * saturate( 1.0 - 18.4 * radius * radius );

|

||||

|

||||

// refractedW

|

||||

float w = n * dot( normalW, viewW );

|

||||

float k = sqrt( 1.0 + ( w - n ) * ( w + n ) );

|

||||

float3 refractedW = ( w - k ) * normalW - n * viewW;

|

||||

|

||||

float cosAlpha = dot(frontNormalW, -refractedW);

|

||||

float dist = height / cosAlpha;

|

||||

float3 offsetW = dist * refractedW;

|

||||

float2 offsetL = mul(offsetW, (float3x2) worldInverse);

|

||||

texcoord += float2(mask, -mask) * offsetL;

|

||||

```

|

||||

## Matcap反射效果

|

||||

```

|

||||

float2 CalcMatcapUV(FMaterialPixelParameters Parameters,float3 normalTexture)

|

||||

{

|

||||

float3 ViewVector=Parameters.CameraVector * -1;

|

||||

float3 ViewSpaceRightVector=normalize(cross(ViewVector , mul( float3(0.0,1.0,0.0) , ResolvedView.ViewToTranslatedWorld )));

|

||||

float3 ViewSpaceUpVector=cross(ViewVector ,ViewSpaceRightVector);

|

||||

|

||||

float3x3 Matrix=float3x3(

|

||||

ViewSpaceRightVector.x,ViewSpaceUpVector.x,ViewVector.x,

|

||||

ViewSpaceRightVector.y,ViewSpaceUpVector.y,ViewVector.y,

|

||||

ViewSpaceRightVector.z,ViewSpaceUpVector.z,ViewVector.z

|

||||

);

|

||||

|

||||

float3 ZeroOneNormal=mul(normalize(Parameters.WorldNormal+normalTexture),Matrix)*0.5+0.5;

|

||||

return float2(ZeroOneNormal.x,ZeroOneNormal.y*-1);

|

||||

}

|

||||

```

|

||||

|

||||

### 这个不太行

|

||||

```

|

||||

//input normalTexture 法线贴图

|

||||

float3 TangentWS=Parameters.TangentToWorld[0];

|

||||

float3 NormalWS=Parameters.TangentToWorld[2];

|

||||

float3 BinormalWS=cross(NormalWS, TangentWS);

|

||||

|

||||

float3 worldNormal;

|

||||

worldNormal.x = dot(float3(TangentWS.x,BinormalWS.x,NormalWS.x), normalTexture);

|

||||

worldNormal.y = dot(float3(TangentWS.y,BinormalWS.y,NormalWS.y), normalTexture);

|

||||

worldNormal.z = dot(float3(TangentWS.z,BinormalWS.z,NormalWS.z), normalTexture);

|

||||

worldNormal = normalize(worldNormal);

|

||||

|

||||

float3 e = normalize(GetWorldPosition(Parameters) - ResolvedView.WorldCameraOrigin);

|

||||

float3 reflectVector = reflect(e, worldNormal);

|

||||

float3 reflectVectorVS = normalize(mul(reflectVector,ResolvedView.TranslatedWorldToView));

|

||||

float m = 2.82842712474619 * sqrt(reflectVectorVS.z + 1.0);

|

||||

float2 cap = reflectVectorVS.xy / m + 0.5;

|

||||

cap=cap*0.5 + 0.5;

|

||||

return cap;

|

||||

```

|

||||

|

||||

## 高光贴图位置调整

|

||||

```

|

||||

//input float2 LeftUp,LeftDown,RightUp,RightDown;

|

||||

|

||||

float3 viewW = mul(float3(0,0,1),(float3x3)View.ViewToTranslatedWorld);

|

||||

float3 viewL = mul(viewW, (float3x2)GetPrimitiveData(Parameters.PrimitiveId).WorldToLocal);

|

||||

float2 viewL2D = normalize(viewL.xy);

|

||||

|

||||

float2 Left=lerp(LeftUp,LeftDown,viewL2D.y);

|

||||

float2 Right=lerp(RightUp,RightDown,viewL2D.y);

|

||||

return lerp(Left,Right,viewL2D.x);

|

||||

```

|

||||

## 焦散

|

||||

- dot(Parameters.WorldNormal,View.DirectionalLightDirection);

|

||||

- Fresnel

|

||||

|

||||

乘以焦散Mask即可

|

||||

98

03-UnrealEngine/卡通渲染相关资料/UEToonShading/EOE.md

Normal file

98

03-UnrealEngine/卡通渲染相关资料/UEToonShading/EOE.md

Normal file

@@ -0,0 +1,98 @@

|

||||

## EOE需求

|

||||

- 渲染功能

|

||||

- 描边功能改进

|

||||

- [x] ScreenPercentage 自适应(移植代码,1小时)

|

||||

- [ ] Fov 自适应 (1~2天)

|

||||

- [ ] 根据投射调整宽度 (1~2天)=> (使用李兄的方案,0天)

|

||||

- [ ] 支持PBR描边控制 (2~4天) => (使用李兄的方案,0天)

|

||||

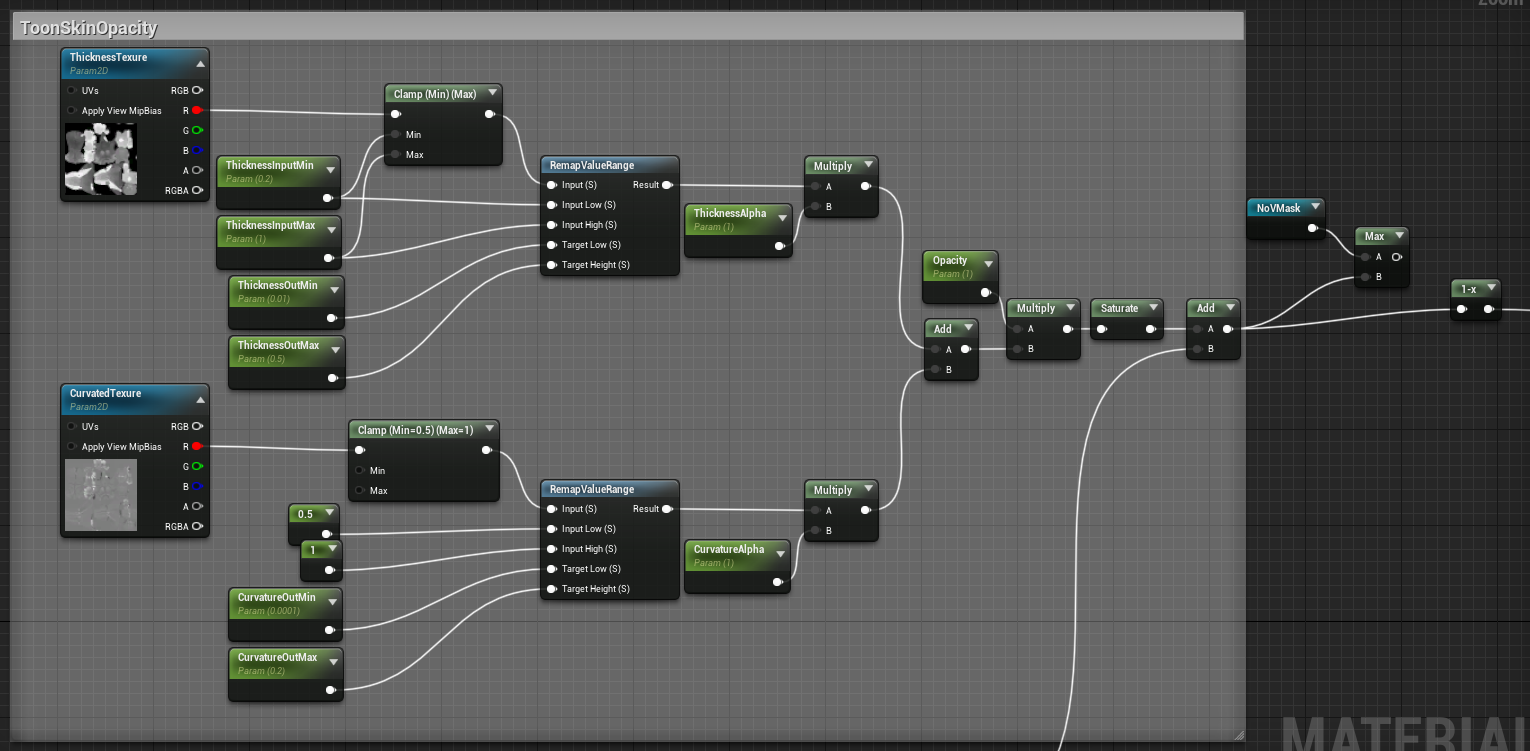

- 厚涂风格卡通皮肤渲染

|

||||

- [ ] 移植厚涂引擎中的代码 (移植代码,2~5天)

|

||||

- 脸部阴影控制

|

||||

- [ ] 角色在向左/向右旋转头部时,面部不会产生阴影和一些残留的”脏”的阴影信息 (14天)

|

||||

- 眼睛

|

||||

- [ ] 眼白阴影 (5天)=>(使用李兄的方案进行进一步开发,1天)

|

||||

- 头发

|

||||

- [ ] 头发高光调整 (移植代码,1天)=>(使用李兄的方案,0天)

|

||||

- 卡通材质重制

|

||||

- ToonStandard (5~7天)

|

||||

- [ ] 制作母材质以及其他Toon材质的MaterialInstance

|

||||

- ToonSkin (1~2天)

|

||||

- ToonHair(1~2天)

|

||||

- ToonCloth

|

||||

- [ ] 制作母材质以及几套衣服的案例。(1~2天)

|

||||

- [ ] 大约40套衣服,每套衣服(上衣、裙子、鞋子、其他饰品)包含3~6个材质球 (时间不确定,而且体力活,可能是乐华那边做了)

|

||||

- 其他功能

|

||||

- 将UE4插件移植到UE5

|

||||

- [ ] ZeroAnim(大致的修改已经完成,等待测试。)

|

||||

- [ ] JsonAssistPlug(大致的修改已经完成,等待测试。)

|

||||

- 角色动画修型(可选)

|

||||

- [ ] 替换潘翔的动画蓝图,使用UE5小灰人自带的PoseDriver进行修型。(没具体研究过时间不确定,14~28天)=> (7~14天)

|

||||

- ShowCase关卡与文档制作

|

||||

- ShowCase关卡(可选)

|

||||

- [ ] ShowCase关卡

|

||||

- [ ] ContentExample关卡

|

||||

- [[#文档]]

|

||||

- [x] 搭建文档系统

|

||||

- [ ] 编写文档(14天左右)

|

||||

- 后续开发计划(看乐华感不感兴趣)

|

||||

- 表情系统

|

||||

- [ ] 开发接近Live2D与MMD的表情系统与相关制作规范 (乐华未提,但后续应该花时间去开发一下)

|

||||

- [ ] 参考 https://www.youtube.com/watch?v=YGZB8-2Kazk 尤其是0:28、2:32左右。 https://www.youtube.com/watch?v=eC_Om8idXTo

|

||||

- [ ] 程序化眼睛 (乐华未提,但后续应该花时间去开发一下)

|

||||

- 定制渲染功能开发

|

||||

- [ ] 乐华那边测试完之后还需要的渲染功能。

|

||||

- 嘴唇效果提升

|

||||

|

||||

|

||||

|

||||

|

||||

## 耗费工时

|

||||

- 楼嘉杰:35~60天 => 30天 主要负责开发功能、打包引擎、编写文档、规划与制作ShowCase ContentExample关卡。

|

||||

- 华湛飞:5天=> 3天左右(并不是连续的5天),负责协助`楼嘉杰` 制作配套资产与贴图。

|

||||

|

||||

## EOE需要制作的资产

|

||||

DAWA 杭州负责把几个ShaderModel的主材质以及材质实例规范做好。同时也会选择一份有代表性的角色资产,制作贴图与材质。

|

||||

|

||||

- 模型(非必要,看透明后处理描边效果再做决定)

|

||||

- 提取角色下颚与嘴唇处的模型,用于头部外扩描边。

|

||||

- 贴图

|

||||

- 不用重新绘制的贴图

|

||||

- BaseColor

|

||||

- Metallic

|

||||

- Roughness

|

||||

- Opacity

|

||||

- Normal

|

||||

- ShadowColor(暗部颜色指定)

|

||||

- ShadowFalloff(阴影过渡控制)

|

||||

- ToonDataTexture(每个贴图4个通道,根据需求绘制,主要适用于控制角色光影交接、轮廓颜色粗细控制、轮廓id)

|

||||

- ToonDataA

|

||||

- ToonDataB

|

||||

- ToonDataC

|

||||

- 厚涂皮肤相关

|

||||

- Trickness(厚涂皮肤材质专用,使用八猴子烘焙Trickness与Curvature混合,并调整后获得)

|

||||

- 次表面颜色贴图

|

||||

- ToonAssetID贴图

|

||||

- 其他

|

||||

- 轮廓FOV自适应曲线资产

|

||||

- 轮廓距离衰减曲线资产

|

||||

- ToonAsset材质集合(一个卡通渲染用材质集,根据需要添加)

|

||||

- 全局贴图(3张预积分贴图,按照需求进行更改)

|

||||

- 材质

|

||||

|

||||

## 项目要求

|

||||

- 渲染功能需求

|

||||

- 将卡通渲染引擎升级至UE5版本。

|

||||

- 描边功能改进。包括ScreenPercentage、Fov自适应;根据投射调整宽度 ;支持PBR描边控制。

|

||||

- 提升卡通皮肤渲染效果。

|

||||

- 实现面部阴影控制功能,使得角色在各个角度的面部阴影都可以控制。

|

||||

- 卡通材质增加眼白阴影效果。

|

||||

- 提升卡通渲染头发高光效果。

|

||||

- 卡通渲染主材质移植。

|

||||

- 其他需求

|

||||

- 将UE4插件ZeroAnim、JsonAssistPlug升级至UE5版本。

|

||||

- 角色动画蓝图移植。

|

||||

|

||||

|

||||

# 竞品参考

|

||||

- 四禧丸子

|

||||

https://www.bilibili.com/video/BV1uy4y1Q7BU/?spm_id_from=333.788.recommend_more_video.5&vd_source=d47c0bb42f9c72fd7d74562185cee290

|

||||

82

03-UnrealEngine/卡通渲染相关资料/UEToonShading/EOE动画计划.md

Normal file

82

03-UnrealEngine/卡通渲染相关资料/UEToonShading/EOE动画计划.md

Normal file

@@ -0,0 +1,82 @@

|

||||

---

|

||||

title: EOE动画计划

|

||||

date: 2023-02-06 20:59:13

|

||||

excerpt:

|

||||

tags:

|

||||

rating: ⭐

|

||||

---

|

||||

|

||||

# 修型

|

||||

1. UE5的骨骼。

|

||||

1. 主要的问题是投入/产出(效果)比。

|

||||

2. 是否于动捕软件匹配。

|

||||

3.

|

||||

|

||||

|

||||

2. 提一嘴骨骼长度与中之人是否匹配。不太清楚 动捕的数据是否会在机器里先做一次重定向?本身UE4的重定向因为算法的局限性,对于身体比例不同的模型会有一些偏移。

|

||||

|

||||

|

||||

- 【初音未来】 「CH4NGE」 运动捕捉 【MMD】

|

||||

https://www.bilibili.com/video/BV1kL4y1A77G/?spm_id_from=333.788.video.desc.click&vd_source=d47c0bb42f9c72fd7d74562185cee290

|

||||

|

||||

- 动捕设备外设

|

||||

|

||||

https://www.bilibili.com/video/BV1Y7411q7m3/?spm_id_from=333.337.search-card.all.click&vd_source=d47c0bb42f9c72fd7d74562185cee290

|

||||

|

||||

# 修型

|

||||

1. 尝试使用曲线来修型。

|

||||

2. 使用PostProcess_AnimBP进行后处理修型。

|

||||

1. 将之前的逻辑移植到后处理动画蓝图中。

|

||||

|

||||

# 保持角色基础结构相同的原因

|

||||

1. 动画资产可以复用。

|

||||

2. 只有一个负责逻辑的主动画蓝图,方便管理。

|

||||

3. 可以使用主动画蓝图设计逻辑,子动画蓝图调节不同参数的功能。

|

||||

4. 对于后续其他衍生品生产会比较友好(手机AR=>Hololive app,ASoul VR演唱会,以及其他延伸游戏)

|

||||

|

||||

## 共享骨架

|

||||

骨架资产的一个重要特性是单个的骨架资产可以由多个骨骼网格体使用,只要其需要拥有相同的整体rig层级。这意味着骨骼命名和骨骼的层级排序必须一致,才能够正确地共享。

|

||||

举个例子,一个骨骼网格体中的一个肢拥有3块骨骼,分别命名为 **1**、**2** 和 **3**:

|

||||

|

||||

|

||||

如果有另一个需要使用相同骨架资源的骨架网格体,则需要保证这些骨骼的命名和排序相同。 然而第二个骨骼网格体可以添加额外或者层级外部的骨骼。如果接收到的动画数据是用于骨骼网格体之外的骨骼,那么该数据会被忽略。

|

||||

|

||||

在这种情况下,你的新层级应该如下所示。在这里,第二个骨骼网格体有着额外的骨骼,但是并没有改变第一个骨架的层级结构,也没有造成冲突。

|

||||

|

||||

|

||||

然而,为使两个骨架网格体使用相同的骨架资源,无法对层级进行重新排序,也无法重命名骨骼。如果第二个骨骼网格体要使用不同的骨骼层级和命名结构,那么需要重新创建一个新的骨骼资产。

|

||||

|

||||

|

||||

如果你在不改变顺序的情况下插入一个骨骼,那么能够正常共享。然而大部分情况下,额外的骨骼可能会导致骨架产生意料之外的变形偏移。我们建议尽量避免这样做。

|

||||

|

||||

结合这些共享规则,再虚幻引擎中有几种方式来在骨骼网格体之间共享骨架。以下是一些细节。

|

||||

|

||||

### 导入期间合并

|

||||

第一种共享骨架的方式是在FBX导入过程期间进行的。导入你的新骨骼网格体时,(包含额外的和外部的骨骼,遵循上述的共享规则),你可以从项目中已有的骨骼网格体中选择一个骨架。虚幻引擎将会将这些骨架合并,并且将全部新骨骼添加到层级中。除此以外,你的骨架的比例会由创建它的原始骨骼网格体来定义。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

## IK Rig 与Fullbody IK

|

||||

[[实时重定向与骨骼动画共用相关#IK Rig In Animation Blueprint]]

|

||||

|

||||

- 解决高跟鞋与平底鞋转换的问题。(应该可以)

|

||||

- 可以解决动捕中一些穿帮问题。

|

||||

|

||||

|

||||

|

||||

嘉然爬椅子

|

||||

https://www.bilibili.com/video/av507701005/?vd_source=d47c0bb42f9c72fd7d74562185cee290

|

||||

|

||||

但更多的是一些用于在交互游戏中比较有用,比如让中之人去按按钮,使用这个技术可以保证伸手按的地方是对得上的。

|

||||

|

||||

## 基础结构相同

|

||||

Skeleton Compatibility,官方翻译为**可兼容的骨架**,不同骨骼之间共享动画的功能。

|

||||

https://docs.unrealengine.com/5.0/en-US/skeletons-in-unreal-engine/#compatibleskeletons

|

||||

|

||||

[[实时重定向与骨骼动画共用相关#UE5实时重定向]]

|

||||

|

||||

## 其他

|

||||

- Motion Wraping

|

||||

- 机器学习 实现肌肉效果

|

||||

408

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U 功能分析与功能列表翻译.md

Normal file

408

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U 功能分析与功能列表翻译.md

Normal file

@@ -0,0 +1,408 @@

|

||||

# VRM4U角色

|

||||

https://hub.vroid.com/en/users/36144806

|

||||

|

||||

B站整理 https://www.bilibili.com/video/BV1gR4y1j7sK/?spm_id_from=333.788.recommend_more_video.2&vd_source=d47c0bb42f9c72fd7d74562185cee290

|

||||

|

||||

- Alicia Solid:https://hub.vroid.com/en/characters/515144657245174640/models/6438391937465666012

|

||||

- AvatarSample_F:https://hub.vroid.com/en/characters/6193066630030526355/models/537531113514541613

|

||||

|

||||

# VRM4U学习笔记

|

||||

VRM4U是一个不错的插件,在此记录一下功能与大致实现方式。

|

||||

快速入门文档:https://ruyo.github.io/VRM4U/01_quick-start/

|

||||

功能介绍视频:https://youtu.be/epcQ-uU6tfU

|

||||

|

||||

视频中的右上角的自定义编辑器可以通过搜索"WBP_"来找到对应的EditorUtilityWidget,之后在Asset上有右键——点击运行EditorUtilityWidget。

|

||||

|

||||

- VRm4U:定义了主要的VrmAssetListObject、VrmMetaObject、VrmLicenseObject、VrmRuntimeSettings以及若干组件与动画节点。

|

||||

- VRM4UImporter:主要的导入相关逻辑实现:导入流程、导入设定窗口、若干动画节点。

|

||||

- VRM4ULoader:导入数据转换以及生成逻辑:数据转换与生成Asset相关的类、UVrmLoaderComponent与若干组件实现。

|

||||

- VRM4UEditor:Sequence编辑器函数EvaluateCurvesFromSequence()实现。

|

||||

- VRM4UMisc:Log日志类型定义。

|

||||

|

||||

PS.

|

||||

- FVRM4UModule模块启动与结束时,会分别注册/卸载

|

||||

- FVRM4UImporterModule模块启动与结束时,会分别注册/卸载 UVrmAssetListObject、UVrmLicenseObject、UVrmMetaObject自定义Asset类型与FVRMRetargetSrcAnimSequenceCustomization自定义属性编辑器。

|

||||

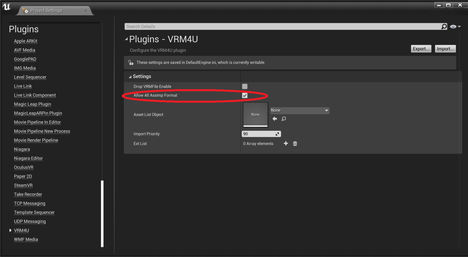

- FVRM4ULoaderModule模块启动与结束时,加载/卸载assimp的动态链接库;如果勾选**Drop VRMFile Enable**,则会

|

||||

|

||||

## VRM4U的格式导入功能

|

||||

值得学习:

|

||||

- Runtime Import功能:在游戏打包后,依然可以通过拖拽文件到游戏窗口的方式来导入VRM文件。

|

||||

- 导入窗口实现:实现一个导入窗口(SVrmOptionWindow),这样Runtime与Editor导入都可以输入自定义的参数。

|

||||

|

||||

待改进:

|

||||

- 没有实现VMD的导入逻辑(虽然实现了BVH格式的导入逻辑)

|

||||

|

||||

### 导入功能

|

||||

VRM4U使用Assimp库来进行格式解析,并且通过修改GLTF来实现VRM格式导入(VRM是基于GLTF开发的)。插件作者也公开了魔改的Assimp代码,当然最好的方式就是下载编译好的库文件与h文件直接引用了。

|

||||

|

||||

得益于Assimp,所以也可以导入PMX格式,但需要勾选 Project Setting>Plugin>VRM4U>Allow All AassImp Format的选项,之后就可以导入PMX格式的模型。(开放格式:pmx、obj、fbx、dae、gltf)

|

||||

|

||||

|

||||

|

||||

同时可以通过下面的Ext List来添加其他格式的后缀名,来使用VRM4U导入。

|

||||

|

||||

主要逻辑位于VRM4UImporter模块的UVRM4UImporterFactory中。

|

||||

|

||||

#### FactoryCreateBinary

|

||||

UVrmImportUI用于存储用户设置的导入选项数据。ULoaderBPFunctionLibrary::GetVRMMeta()用来导入VRM的Meta数据。ULoaderBPFunctionLibrary::LoadVRMFileFromMemory()为核心导入逻辑。

|

||||

|

||||

导入流程为:

|

||||

1. 在初始化UVrmImportUI(导入选项对象)后,会调用ULoaderBPFunctionLibrary::GetVRMMeta(),通过Assimp读取VRM文件的Meta数据(缩略图与版权信息)来填充UVrmImportUI。对于PMX格式会有额外的设置。(模型缩放1=>0.1、不合并材质、不合并图元、强制材质双面显示)

|

||||

2. 取得父窗口,之后创建并添加自定义的SWindow2包裹SVrmOptionWindow来进行导入参数显示,会在用户选择好数据后,进行之后的步骤。

|

||||

3. 创建TAssetPtr<UVrmAssetListObject>、TArray< TAssetPtr<UObject> >、TAssetPtr<UClass>对象。

|

||||

4. 取得默认加载设置对象UVrmRuntimeSettings,之后会依次尝试载入VrmObjectListBP、VrmAssetListObjectBP、UVrmAssetListObject来初始化上一步说的TAssetPtr<UVrmAssetListObject>。

|

||||

5. 创建static VRMConverter::Options并使用之前的用户修改过的设置选项进行初始化。

|

||||

6. 使用上一步取得选项对象,并调用ULoaderBPFunctionLibrary::LoadVRMFileLocal()来导入文件。导入的存放在UVrmAssetListObject mret中。

|

||||

7. 返回mret->GetOuter();

|

||||

|

||||

#### LoadVRMFileFromMemory

|

||||

1. 根据后缀名设置对应参数

|

||||

2. 调用Assimp::Importer的ReadFileFromMemory()或者ReadFile()读取文件来获取场景节点aiScene。

|

||||

3. 创建UVrmAssetListObject* OutVrmAsset(复制InVrmAsset或NewObject)

|

||||

4. 使用VRMConverter对象,取出VRM的Json与aiScene数据来以此初始化。之后更新OutVrmAsset里的数据(调整材质的AlphaCutoff选项、替换骨骼名称、转换并且生成贴图与材质、转换VRM的Meta数据、转换并且生成模型数据、重命名Meta数据、设置骨骼模型的Rig Pose MorphTarget、转换重定向用的Humanoid、将之前所有数据保存成Asset)

|

||||

|

||||

#### 运行时导入

|

||||

主要的逻辑为调用LoadVRMFileAsync()加载文件并且初始化UVRMAssetList,之后再设置SkeletalMesh或者SpawnActor等一系列设置。

|

||||

|

||||

使用这个功能前首先得确定 Project Settings->Plugin->VRM4U->Drop VRMFile Enable处于勾选状态才能使用这个功能。

|

||||

功能演示可以查看参考插件Content的Maps/VRM4U_runtimeload,其功能位于DropActor。其挂载了UVrmDropFilesComponent组件,并在Beginplay绑定UVrmDropFilesComponent组件的OnDrogFile委托。其绑定的LoadVrmFronFilePath事件主要逻辑为:创建VRMAssetList对象,之后调用LoadVRMFileAsync()加载文件。之后给SpawnMToonActor,并给骨骼物体设置动画。(还有一些逻辑在关卡蓝图中)

|

||||

|

||||

UVrmDropFilesComponent的主要功能

|

||||

|

||||

它定义了2个委托,并会在组件注册/卸载时让StaticOnDropFilesDelegate绑定/解绑OnDropFilesDelegate_Handler()。OnDropFilesDelegate_Handler()会调用OnDropFiles.Broadcast(FileName);

|

||||

```c++

|

||||

DECLARE_MULTICAST_DELEGATE_OneParam(FStaticOnDropFiles, FString);

|

||||

static FStaticOnDropFiles StaticOnDropFilesDelegate;

|

||||

|

||||

DECLARE_DYNAMIC_MULTICAST_DELEGATE_OneParam(FOnDropFiles, FString, FileName);

|

||||

|

||||

UPROPERTY(BlueprintAssignable)

|

||||

FOnDropFiles OnDropFiles;

|

||||

```

|

||||

|

||||

UVrmDropFilesComponent::VRMGetOpenFileName()会在关卡蓝图中被调用,用于调用Winapi的GetOpenFileName()来显示一个打开文件用的窗口,在选取了文件之后会调用DropActor的LoadVrmFronFilePath()。

|

||||

|

||||

##### 运行时拖拽导入

|

||||

FDropMessageHandler的父类为IWindowsMessageHandler是一种用与处理Windows消息的一种接口类。FDropMessageHandler的主要逻辑为:

|

||||

1. 取得UVrmDropFilesComponent组件与World指针。

|

||||

2. 如果世界类型为Game与PIE则调用Winapi的DragAcceptFiles()

|

||||

3. 调用Winapi的DragQueryFile()查询拖拽入的文件,并将文件地址传**UVrmDropFilesComponent::StaticOnDropFilesDelegate.Broadcast(Filepath);**

|

||||

|

||||

在FVRM4ULoaderModule::StartupModule()中执行增加MessageHandler。

|

||||

```c++

|

||||

if (FSlateApplication::IsInitialized()) {

|

||||

static FDropMessageHandler DropMessageHandler;// = FDropMessageHandler();

|

||||

//FWindowsApplication* WindowsApplication = (FWindowsApplication*)GenericApplication.Get();

|

||||

TSharedPtr<GenericApplication> App = FSlateApplication::Get().GetPlatformApplication();

|

||||

|

||||

if (App.IsValid()) {

|

||||

auto WindowsApplication = (FWindowsApplication*)(App.Get());

|

||||

|

||||

//WindowsApplication->SetMessageHandler(DropMessageHandler);

|

||||

WindowsApplication->AddMessageHandler(DropMessageHandler);

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

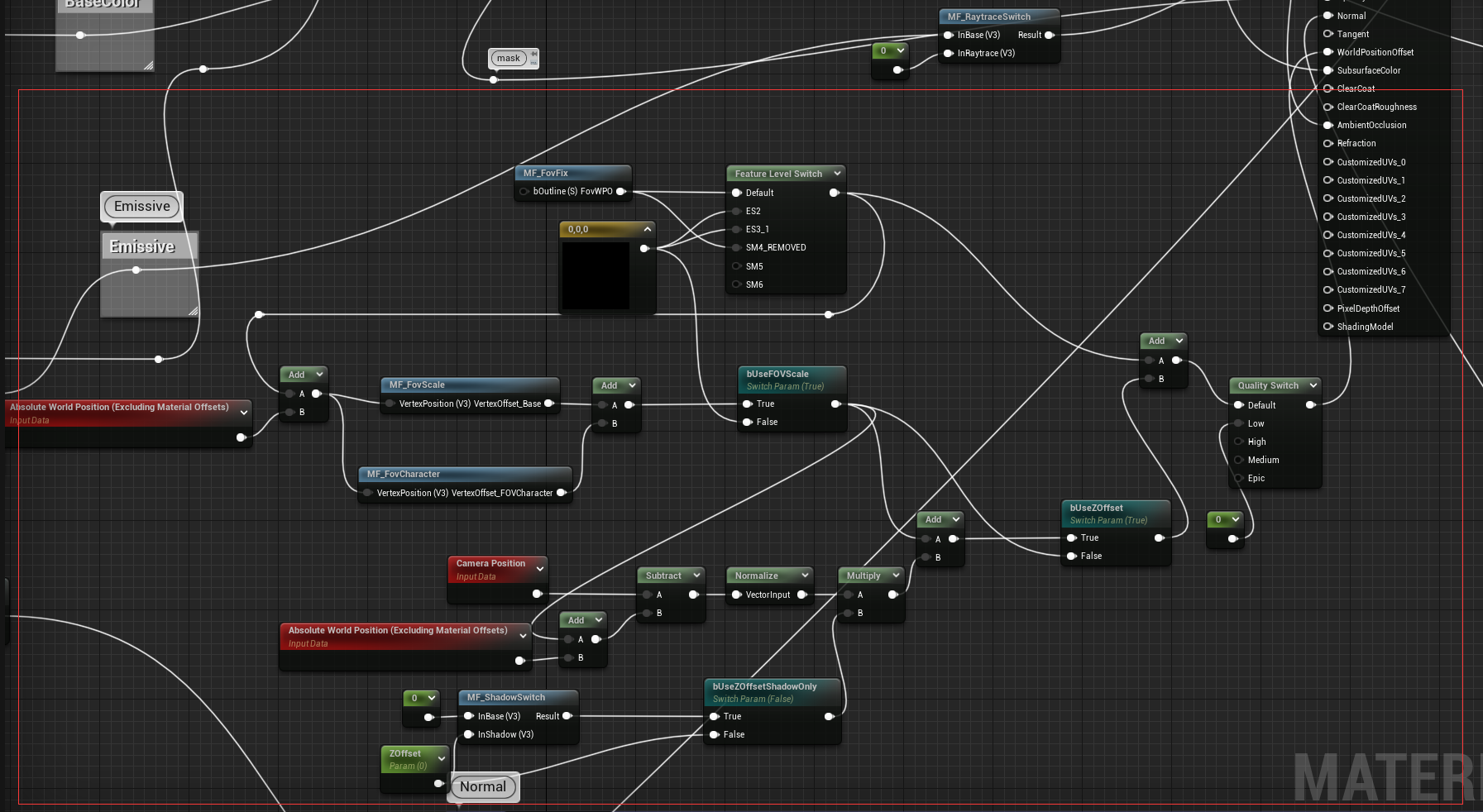

## 渲染与材质

|

||||

值得学习:

|

||||

- 卡通渲染材质(里面有一些faker技巧)

|

||||

- 拍摄模式

|

||||

- Over Parse,模型压平的二次元模式,视角矫正效果

|

||||

|

||||

VRM4U的MToon Lit、MToon Unlit、Subsurface、Subsurface Profile材质类型都是基于MaterialUtil\MToonUtil\M_VrmMToonBaseOpaque,它是作者实现的一个接近UniVRM Shader效果的材质。里面有一些Hack技巧值得学习。上述这几材质类型的区别在于材质实例的属性不同,以MToon Lit与MToon Unlit的区别为例:

|

||||

1. bUseLight是否勾选

|

||||

2. ShaderModel不同:Default Lit与Unlit

|

||||

|

||||

Unlit、PBR基于一个简单材质MaterialUtil\MToonUtil\M_VrmSimple。

|

||||

|

||||

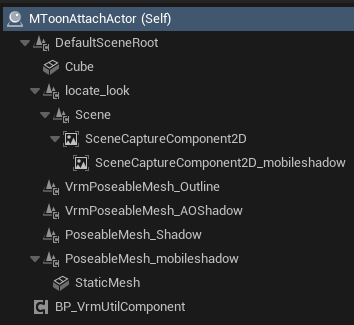

### 轮廓线与投射阴影

|

||||

使用MToonAttachActor来应用轮廓线和自身阴影(Unlit ShaderModel不会接收其他物体的投影)。自己制作的VRM模型可能会有问题,导致Outline与阴影不能出现,建议使用Vroid官方模型进行测试。

|

||||

|

||||

|

||||

|

||||

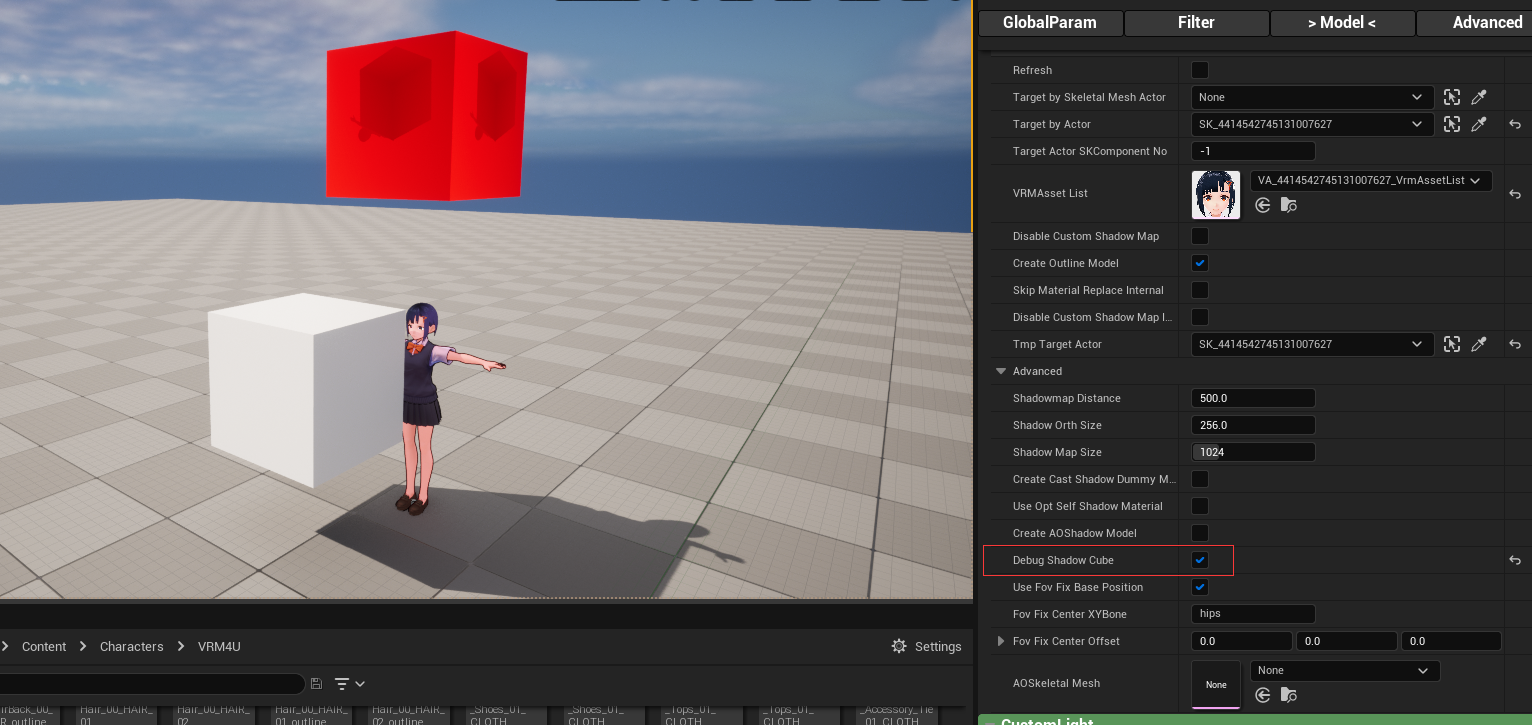

- SceneCaptureComponent2D组件用于渲染Depth到RT上,以此来制作Shadow。勾选WBP_VRMMaterial->Model->MToonAttachActor->Advanced->Debug Shadow Cube后,会在角色正上方显示深度贴图Cube。

|

||||

|

||||

|

||||

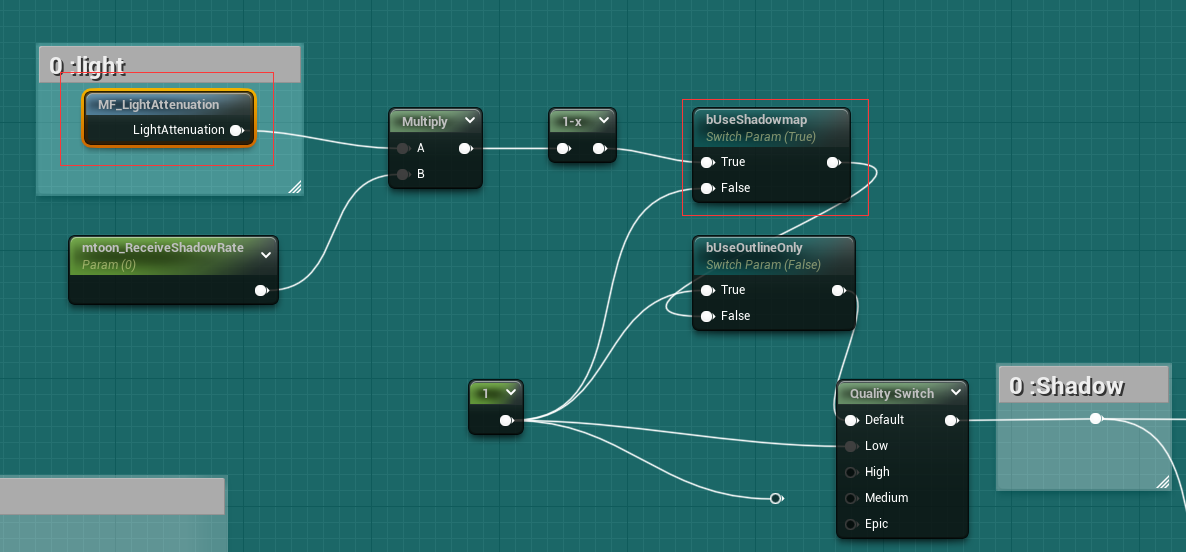

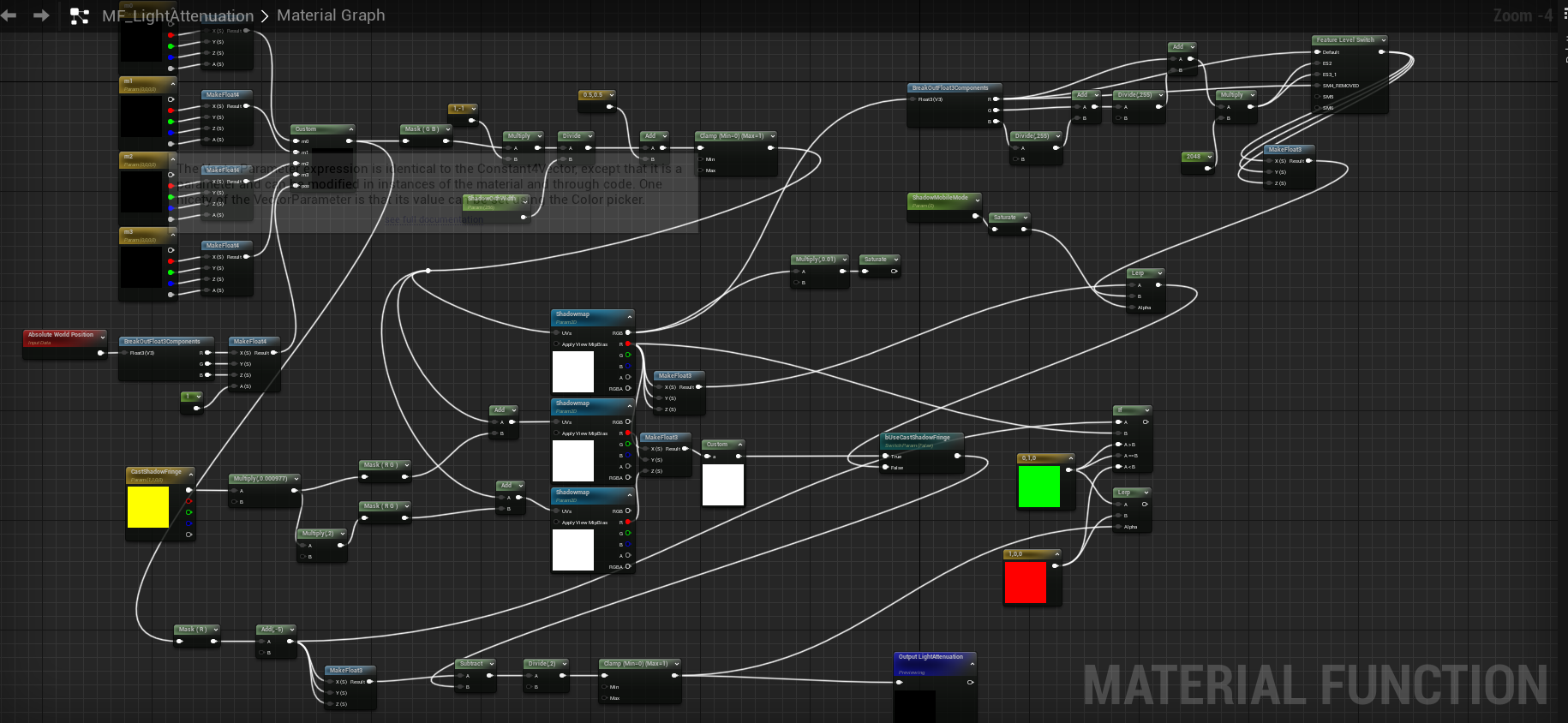

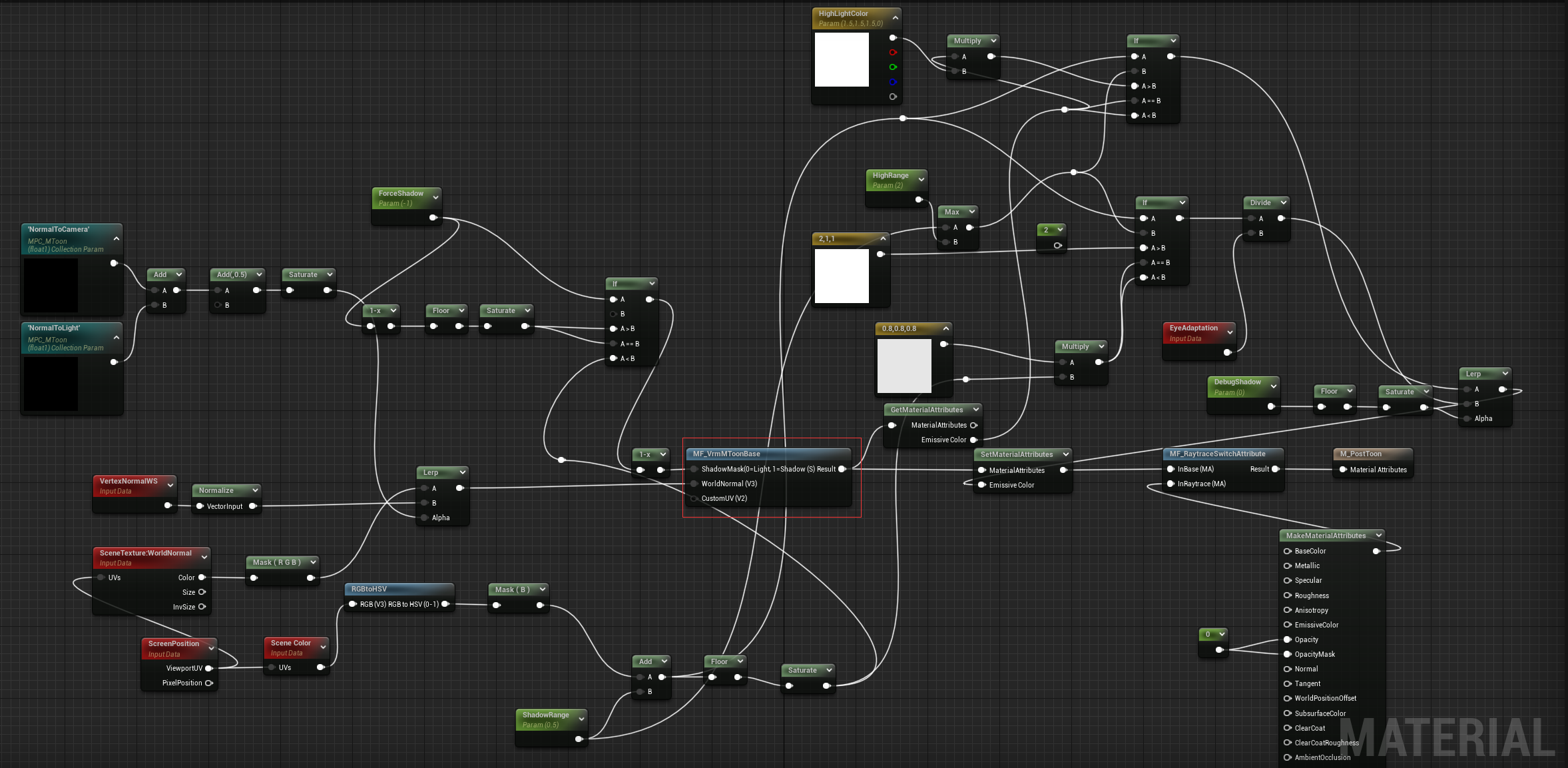

在MF_VrmMToonBase中搜索bUseShadowMap就可以找到所引用的计算函数

|

||||

|

||||

里面逻辑就是通过Depth贴图计算ShadowMask

|

||||

|

||||

|

||||

- UVrmPoseableMeshComponent:用于实现Outline(AOShadow目前没有作用)。主要使用M_VrmNone,一个Masked Unlit材质,通过模型外扩实现Outline效果。

|

||||

|

||||

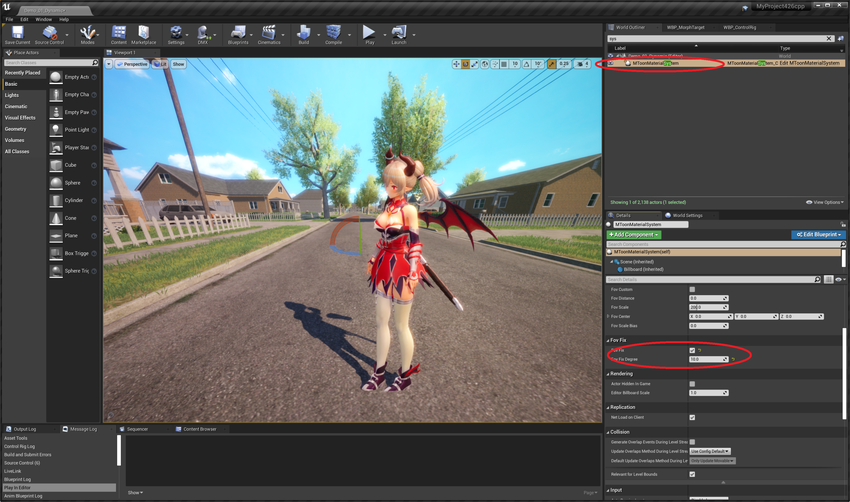

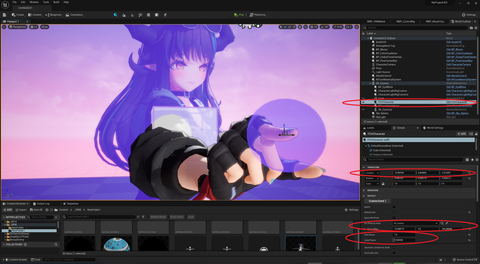

### 后处理效果

|

||||

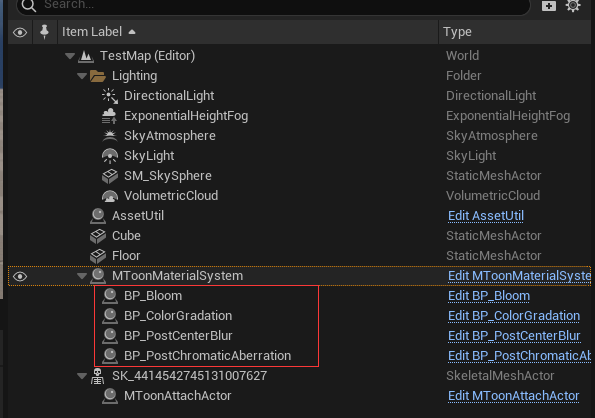

MToonMaterialSystem

|

||||

|

||||

|

||||

|

||||

这些蓝图BP的大致逻辑为,挂载带有PostProcess空间组件的BP,之后往里面添加PostProcess材质。

|

||||

|

||||

Content\Util\Actor\Post\sub目录中有

|

||||

- M_PostBloom

|

||||

- M_ColorGradation

|

||||

- MI_ColorGradation

|

||||

- M_CenterBlur

|

||||

|

||||

### 光照工具与PostToon

|

||||

- VRM4U_CameraLight有演示CharacterLightRigActor,方便用户快速摆出主光、轮廓光,其中轮廓光会一直对着摄像机旋转。

|

||||

VRM4U有关的曝光的参数调节技巧:https://ruyo.github.io/VRM4U/02_envlight/

|

||||

|

||||

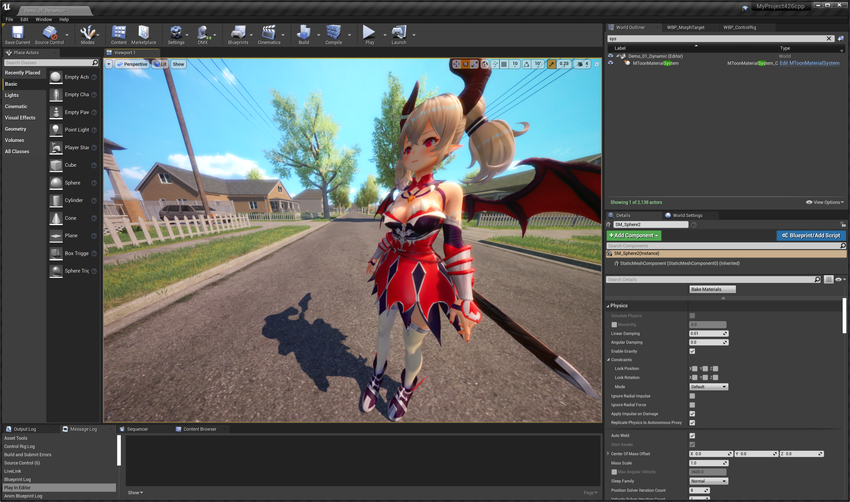

- PostToonSystem文档:https://ruyo.github.io/VRM4U/02_toon/

|

||||

|

||||

具体可以参考VRM4U_PostToon.umap,设置步骤如下:

|

||||

1. 在场景中放置一个SkeletalMeshActor。

|

||||

2. 在场景中放置一个BP_PoseCopyToon,并且设置Target Actor为上一步放置的SkeletalMeshActor,并调整参数。

|

||||

|

||||

#### PostToon原理

|

||||

首先BP_PoseCopyToon挂载了5个组件(隐藏了2个非重要组件),SkeletalMesh为主要渲染,VrmPoseableMesh用于接受光照。

|

||||

- SkeletalMesh

|

||||

- VrmPoseableMesh

|

||||

- VrmPoseableMesh_translucent

|

||||

|

||||

1. 设置TargetMeshForLight(SkeletalMesh或者VrmPoseableMesh)

|

||||

2. BP_PoseCopyToon会在一开始遍历TargetMeshForLight的Materials,之后根据材质数目给VrmPoseableMesh添加对应数目的MI_BaseLight材质。(M_BaseLight与MToon材质大致一样,都使用MF_VrmMToonBase)

|

||||

3. 给VrmPoseableMesh_translucent执行上一步类似操作,但添加的材质为MI_PostToon。

|

||||

4. 如果SkeletalMesh中有使用M_VrmNone材质,那VrmPoseableMesh与VrmPoseableMesh_translucent的对应部分也会被设置成M_VrmNone。

|

||||

5. 隐藏Debug用的VrmPoseableMesh_translucent。

|

||||

6. 调用VrmPoseableMesh的VRMSetLightingChannelPrim()。设置了图元的LightingChannel。

|

||||

7. 调用VrmPoseableMesh_translucent的VRMSetPerBoneMotionBlur()。设置SkinnedMesh->bPerBoneMotionBlur,默认是true。

|

||||

|

||||

|

||||

|

||||

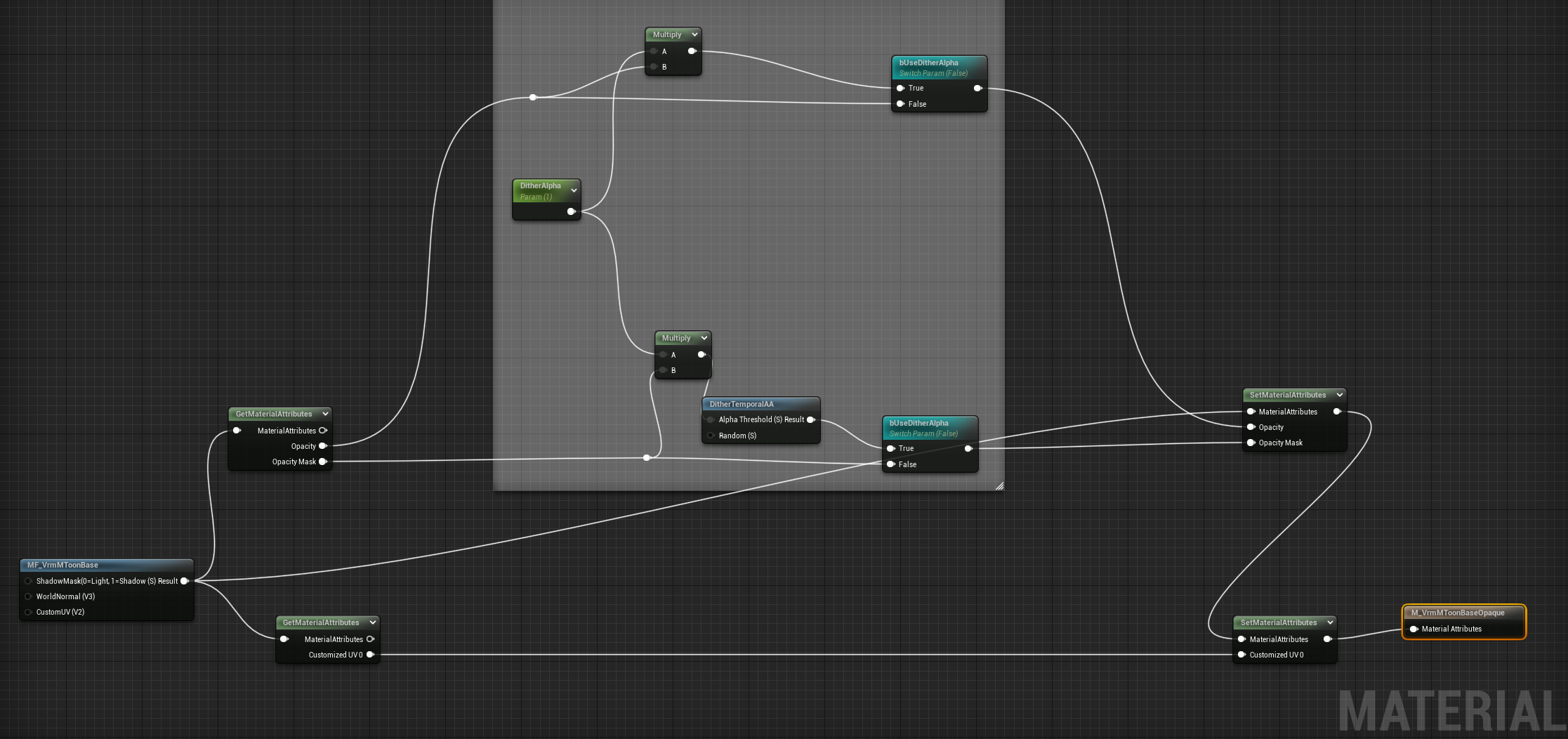

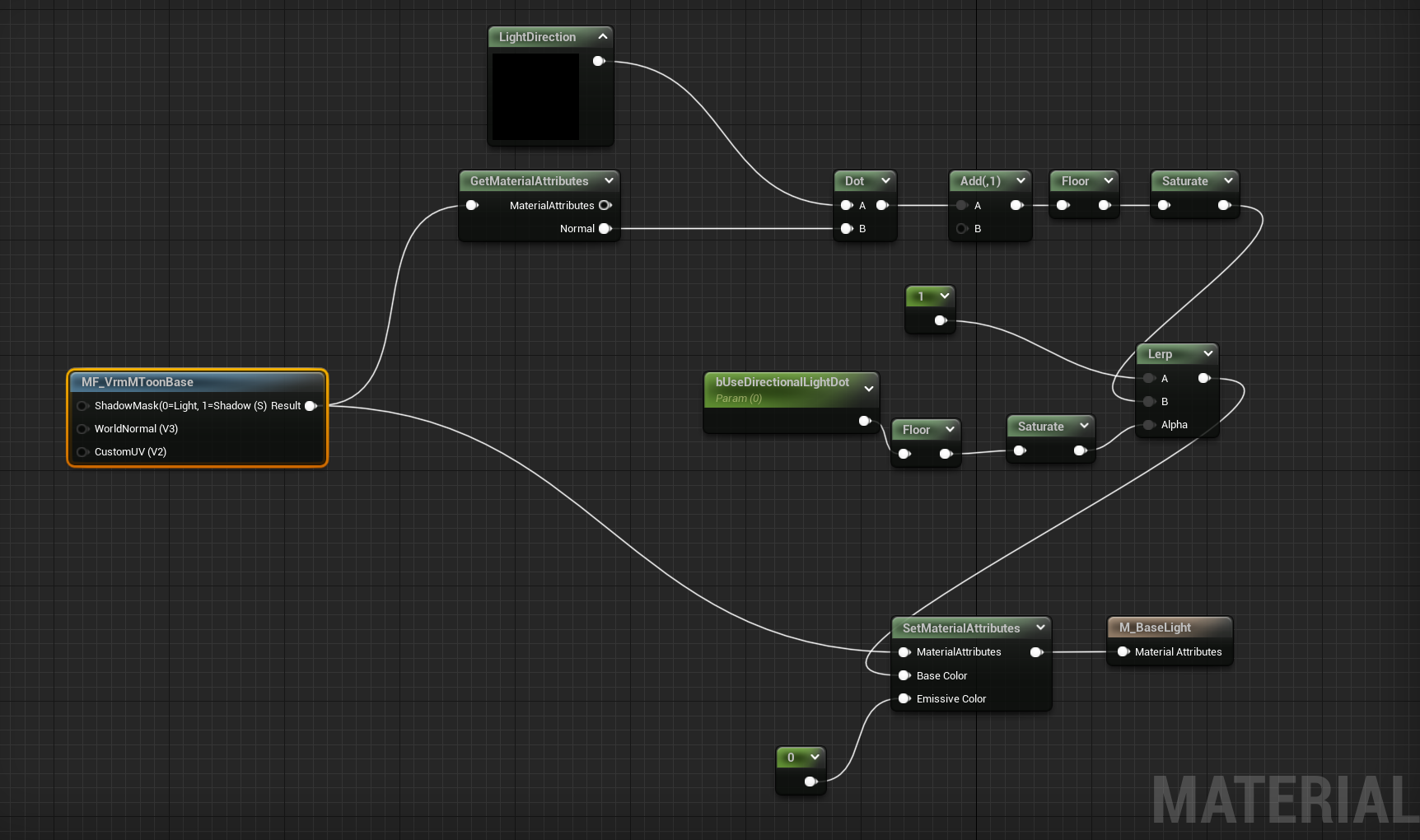

##### M_VrmMToonBaseOpaque、M_BaseLight、M_PostToon比较

|

||||

- M_BaseLight:有基础灯光计算(NoL)。**实际使用的是MI_BaseLight**所以会有一些参数改变:比如他是一个PBR材质,有调整过BaseColor、Metalic、Roughness。

|

||||

- M_ToonPost

|

||||

- M_VrmMToonBaseOpaque:实现了TAA透明效果

|

||||

|

||||

M_VrmMToonBaseOpaque

|

||||

|

||||

|

||||

M_BaseLight:用于渲染光照效果

|

||||

|

||||

|

||||

M_ToonPost:用于取得光照效果并且合成在一起。使用SceneColor节点取得上一个Material渲染的结果作为灯光结果(因为是透明材质,所以是在后面渲染的)。

|

||||

|

||||

|

||||

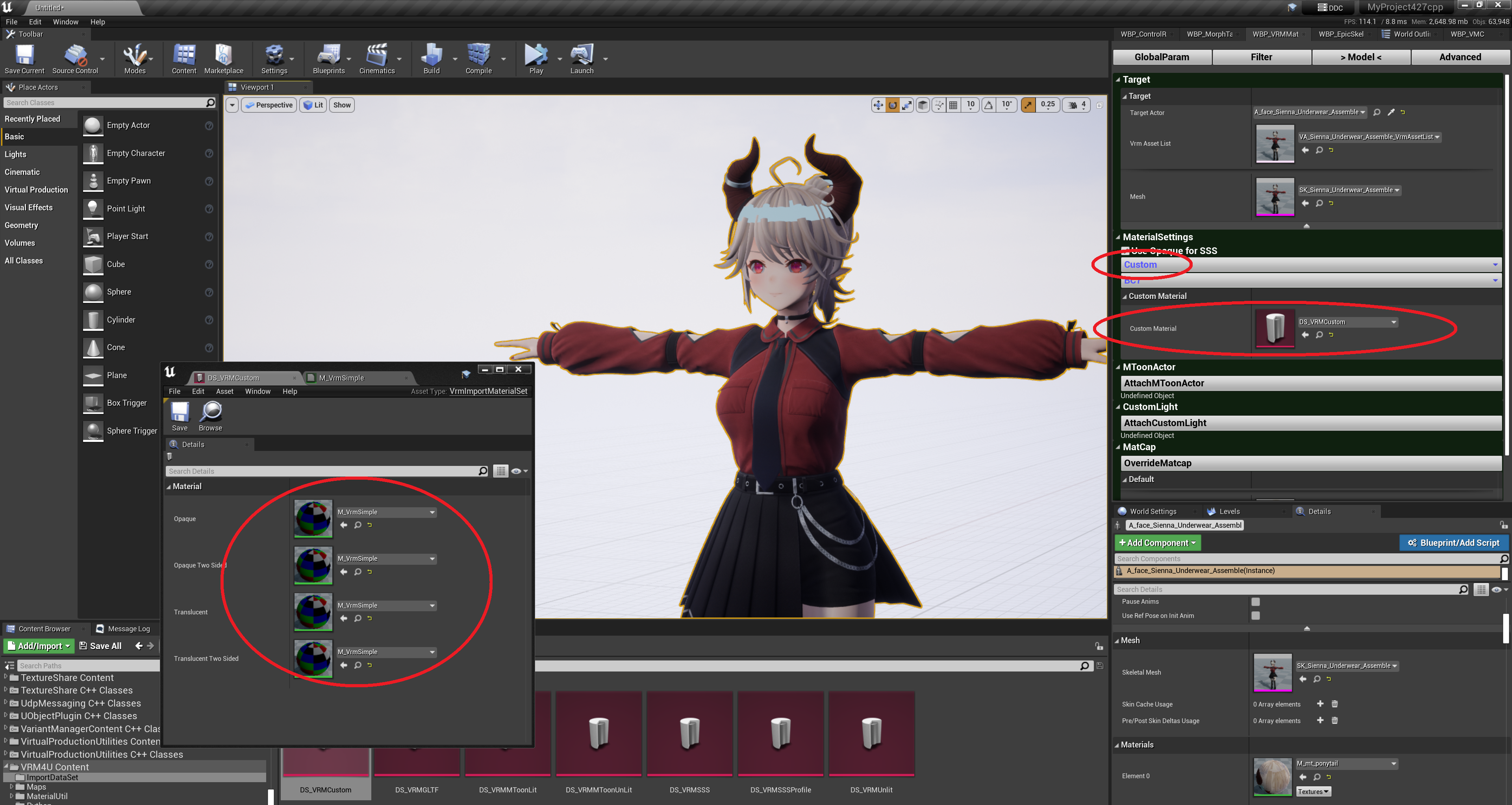

#### 使用Custom Material

|

||||

VRM4U可以使用自定义的材质系统代替MToon材质。

|

||||

|

||||

1. 根据M_VrmSimple的格式,创建自己的CustomMaterial。

|

||||

2. 创建DS_VRMCustom DataAsset并且填入对应的Custom Material Instance(改变Shader Model与Blend Mode)。

|

||||

3. 在操作面板WBP_VRMMaterial的MaterialSettings上,将材质模型设置成Custom,并且填入上面创建的DS_VRMCustom DataAsset。

|

||||

|

||||

|

||||

|

||||

|

||||

### 其他Hack技巧

|

||||

- Anti-ToneMapping:使用UE自带的函数抵消ToneMapping效果。

|

||||

- Exposure:使用EyeAdaptation节点控制亮度。

|

||||

|

||||

|

||||

|

||||

### 拍摄模式

|

||||

1. 使用BP_VrmModelActor。

|

||||

2. 视线跟踪 /VRM4U/Util/Actor/Misc/LookAtPoint放置TargetActor并设置目标模型。

|

||||

3. VRM4U的角色相机使用Pawn类实现:提供若干快捷操作方便用户得到最佳的镜头。https://ruyo.github.io/VRM4U/02_shortcut2/

|

||||

4. 使用MToonMaterialSystem调整阴影效果。

|

||||

5. 使用MorphControl控制角色表情(目标设置为BP_VrmModelActor)。

|

||||

|

||||

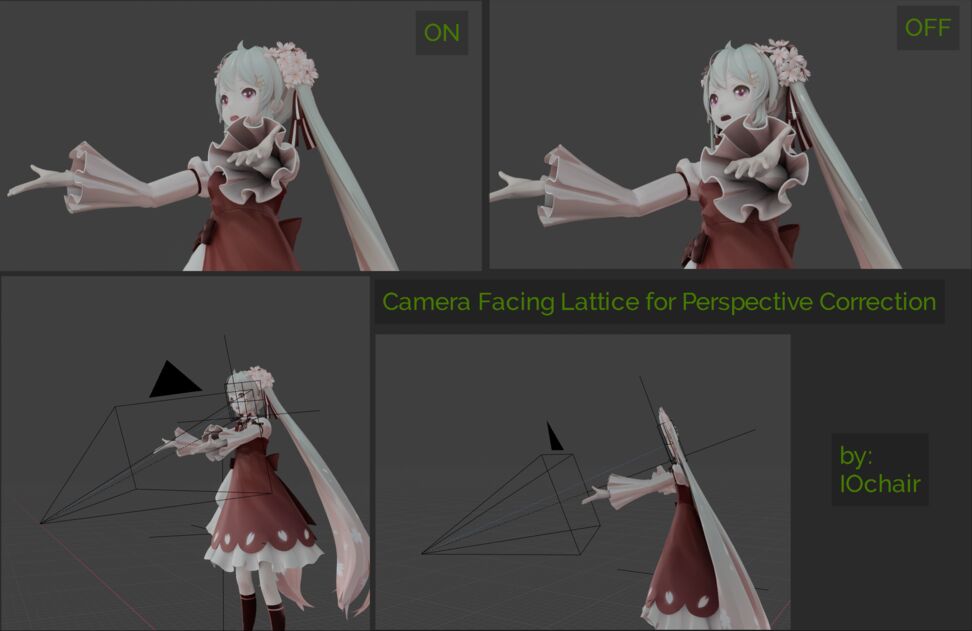

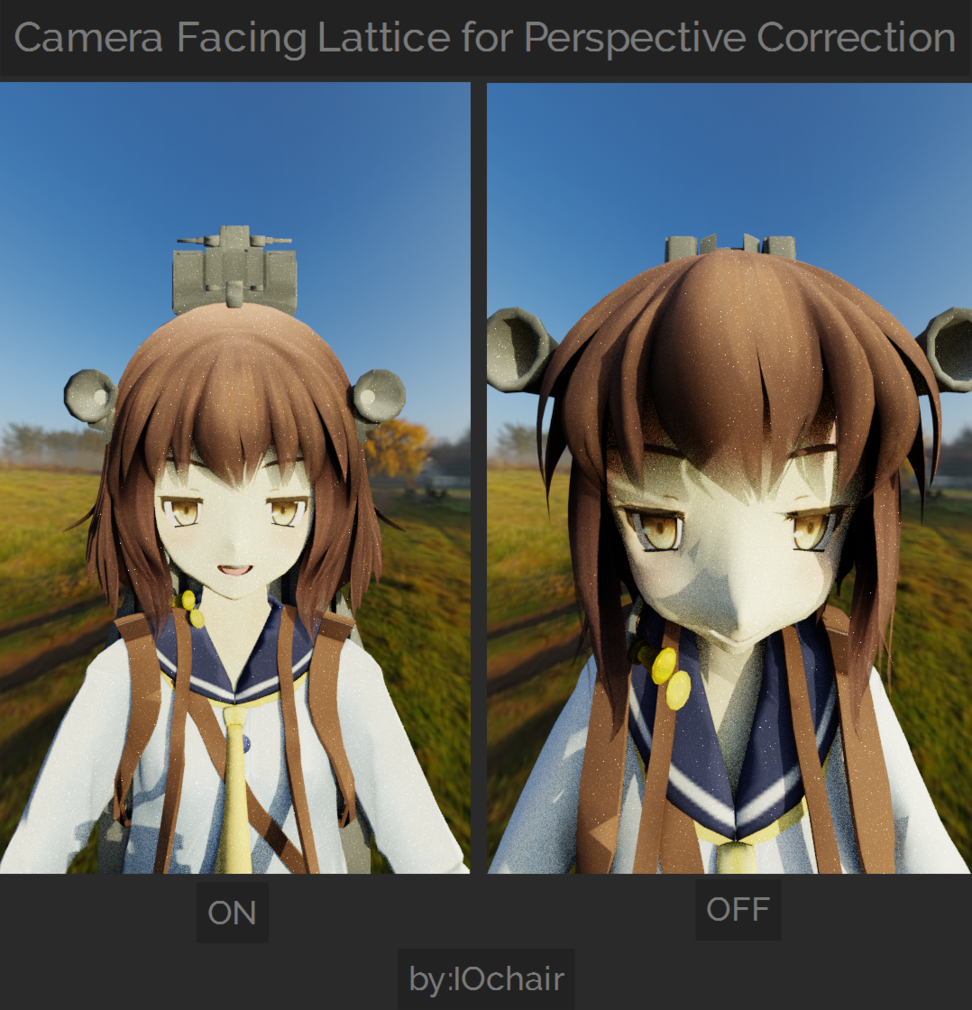

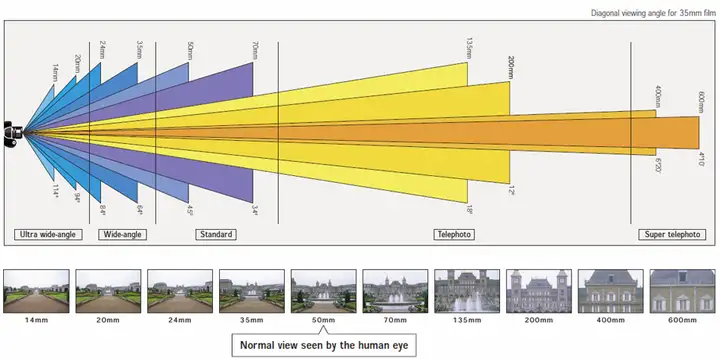

### Over Parse

|

||||

文档:https://ruyo.github.io/VRM4U/02_pers/

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

Actor位于Util\Actor\:

|

||||

- FOVCharacter

|

||||

- FOVCustom

|

||||

|

||||

FOVCustom使用了VrmCameraCheck组件,并且会在蓝图的Construction Script中绑定SetFovDistance()至CameraMove委托。主要的逻辑位于SetFovDistance()中,主要逻辑Tick()也会使用。

|

||||

1. 将FOVCustom Attach 到 TargetActor上。

|

||||

2. 寻找场景中所有MToonMaterialSystem,并设置FovScaleBias、Fov_distance、Fov_scale参数并应用。

|

||||

|

||||

FOVCharacter逻辑相似,核心逻辑在CustomEvent_1中,他会绑定给VrmCameraCheck组件的CameraMove委托。主要设置了**材质集**的FOV2Begin、FOV2Pow、FOV2Scale、FOV2ScaleLimit、FOV2FarCenter、FOV2FarPoint、MainCameraPosition、MainCameraDirection。相关逻辑位于材质中。

|

||||

|

||||

|

||||

|

||||

## 动画

|

||||

值得学习:

|

||||

- Runtime Retarget功能

|

||||

- Limited Animation(抽帧动画)

|

||||

- Control Rig与Morph Target控制器

|

||||

|

||||

实现动画节点:

|

||||

- VRM4U

|

||||

- AnimNode_VrmCopyHandBone

|

||||

- AnimNode_VrmModifyBoneDynamic

|

||||

- AnimNode_VrmModifyBoneList

|

||||

- AnimNode_VrmModifyHumanoidBone

|

||||

- AnimNode_VrmQuestHandBone

|

||||

- AnimNode_VrmRetargetFromMannequin

|

||||

- AnimNode_VrmSpringBone

|

||||

- AnimNode_VrmVMC

|

||||

- VRM4UImporter

|

||||

- AnimGraphNode_VrmCopyHandBone

|

||||

- AnimGraphNode_VrmModifyBoneDynamic

|

||||

- AnimGraphNode_VrmModifyBoneList

|

||||

- AnimGraphNode_VrmModifyHumanoidBone

|

||||

- AnimGraphNode_VrmQuestHandBone

|

||||

- AnimGraphNode_VrmRetargetFromMannequin

|

||||

- AnimGraphNode_VrmSpringBone

|

||||

- AnimGraphNode_VrmVMC

|

||||

|

||||

### BP_VrmPoseCopy

|

||||

挂载了以下5个组件,有一个子类BP_VrmPoseCopy_PostShadow。

|

||||

- VrmPoseableMesh

|

||||

- BP_VrmAnimControlComponent

|

||||

- BP_VrmUtilComponent

|

||||

- SkeletalMesh

|

||||

|

||||

有关抽帧效果,其关键函数在于BP_VrmAnimControlComponent或者BP_VrmPoseCopy的SetFrameLimite(),函数是一个无线循环函数。

|

||||

1. 判断是否开启EnableFrameLimit,不开启就结束了

|

||||

2. SetFrameLimite()中判断当前播放帧数是否达到nextToPlay变量的值,如果没有则等待;有则执行VrmPoseableMesh的VRMCopyPoseAndMorphFromSkeletalComponent()

|

||||

3. 更新nextToPlay变量并触发OnFrameLimitUpdate委托。

|

||||

4. 在更新完模型的Transform后,跳回第2步。

|

||||

|

||||

**改进思路**:在蓝图中这样实现会有很大的性能问题,使用c++会更好。而且这个逻辑完全可以使用动画蓝图实现,使用PoseCache,之后根据条件,输出更新Pose或是PoseCache。

|

||||

|

||||

UVrmPoseableMeshComponent继承自UPoseableMeshComponent。

|

||||

```c++

|

||||

void UVrmPoseableMeshComponent::VRMCopyPoseAndMorphFromSkeletalComponent(USkeletalMeshComponent* InComponentToCopy) {

|

||||

if (InComponentToCopy) {

|

||||

Super::CopyPoseFromSkeletalComponent(InComponentToCopy);

|

||||

|

||||

MorphTargetWeights = InComponentToCopy->MorphTargetWeights;

|

||||

ActiveMorphTargets = InComponentToCopy->ActiveMorphTargets;

|

||||

}

|

||||

}

|

||||

```

|

||||

CopyPoseFromSkeletalComponent()的主要逻辑就是判断骨骼是否一一对应,如果对应则使用移动构造函数对Target与Source骨骼数据进行交换;不对应就遍历复制骨骼数据。

|

||||

|

||||

#### Limited Animation 抽帧效果

|

||||

文档地址:https://ruyo.github.io/VRM4U/05_limitedanim/

|

||||

|

||||

使用步骤

|

||||

1. 在关卡上放置一个执行通常动画的骨架模型Actor。设置为“始终勾选姿势并刷新骨骼”以将动画移动到屏幕之外。

|

||||

2. 在关卡中放置一个BP_VrmPoseCopy Actor,并TargetActor设置为上一步中的骨骼模型。打开LimitedAnim,输入你要播放的帧率(12、24等,每秒的帧数)。

|

||||

|

||||

#### 运行时重定向

|

||||

文档:https://ruyo.github.io/VRM4U/03_gray/

|

||||

视频(UE5的实时重定向方案):https://www.bilibili.com/video/BV1HZ4y117Yk?spm_id_from=333.999.0.0

|

||||

|

||||

视频中的步骤:

|

||||

1. 给新导入的VRM4U模型添加重定向骨骼链数据。

|

||||

2. 新建IK Rig Asset并选择IK_Mannequin。(假设使用UE5小蓝人来重定向)

|

||||

3. 新建IK Retarget Asset,设置Source为IK_Mannequin的Rig,Target为上一步新建的Rig。

|

||||

4. 修改TPose=>APose。

|

||||

|

||||

5. 在角色类中的Mesh下面新建一个SkeletalMesh组件,并且选择新导入的VRM4U模型。创建一个动画蓝图Asset并指定(我感觉并不需要挂载新创建的SkeletalMesh)。

|

||||

6. 动画蓝图中使用RetargetPoseFromMesh节点。

|

||||

7. 将角色类中Mesh的VisibilityBasedAnimTickOption属性改为AlwaysTickPose=>AlwaysTickPoseAndRefreshBones。

|

||||

8. 隐藏新建的SkeletalMesh组件。

|

||||

|

||||

VRM4U的实时重定向步骤:

|

||||

1. 将BP_VrmMannequinRetarget放入场景中,之后设置Targetmannequin。

|

||||

2. 设置VRM Asset List Override。

|

||||

3. 最后点击GenerateRegargetPoseCopy即可。

|

||||

|

||||

|

||||

|

||||

BP_VrmMannequinRetarget使用了动画蓝图ABP_VRoidSimpleMannequinRetarget,里面使用了VrmRetargetFromMannequin节点。大致逻辑就是遍历所有的骨骼(humanoid_bone)之后进行重定向。本质上与UE5的方法一样,但UE5使用最新的骨骼链算法,无论是便捷与效果都更胜一筹。

|

||||

|

||||

## 其他工具与实现

|

||||

- 面部捕捉

|

||||

- VirtualMotionCapture(VMC) 身体捕捉 https://ruyo.github.io/VRM4U/08_vmc/

|

||||

|

||||

VMC入门资料:

|

||||

1. UE VR Track介绍(视频中使用了SteamVR控制器手柄):https://www.bilibili.com/video/BV1kS4y167SK?spm_id_from=333.337.search-card.all.click

|

||||

2. UE VRN4U VMC功能讲解:https://www.bilibili.com/video/BV1ub4y1Y74K?spm_id_from=333.337.search-card.all.click

|

||||

3. 捕捉数据软件介绍(Up推荐VseeFace,免费、效果好):https://www.bilibili.com/video/BV1DK411u75k?spm_id_from=333.999.0.0

|

||||

4. Vseeface和OBS的设置:https://www.bilibili.com/video/BV16K4y1H7Cb?spm_id_from=333.999.0.0

|

||||

5. VSeeFace配合LeapMotion:https://www.bilibili.com/video/BV1KA41137os?spm_id_from=333.337.search-card.all.click

|

||||

6. 全身动作捕捉软件ThreeDPoseTracker:https://www.bilibili.com/video/BV1vy4y157An?spm_id_from=333.999.0.0

|

||||

|

||||

## 其他模块文件

|

||||

- VRM4U

|

||||

- VrmUtil:导入选项、GetXXX工具函数、骨骼转换映射表

|

||||

- VrmUtilImage:图片处理函数

|

||||

- VRM4UImporter

|

||||

- VRM4UDetailCustomize:针对FVRMRetargetSrcAnimSequence的自定义编辑器

|

||||

- VrmAssetListThumbnailRenderer:Asset缩略图渲染控制

|

||||

|

||||

Util中的工具

|

||||

Actor

|

||||

- latest:作者研发用的文件夹,里面的东西会引起打包出问题,建议在打包的时候删掉。

|

||||

|

||||

# VRM4U 功能列表翻译

|

||||

- Asset输出支持日语名称

|

||||

- 显示许可证与文件的Meta信息

|

||||

- bvh 支持

|

||||

|

||||

## 骨骼动画

|

||||

- MorphControlActor。支持VRoid模型的Morph Target,并且名称与原始数据相同

|

||||

- 视线跟随Actor

|

||||

- 增加动画节点:VRMSpringBone

|

||||

- 默认重定向是 A-pose。启用以更改为常规 T 姿势作为选项

|

||||

- 增加套用ALS功能(添加IKBone,复制VirtualBone,创建骨骼名称为UE4 Mannequin)

|

||||

- 可以从其他骨骼Asset上复制Socket

|

||||

- 实现了 WindActor

|

||||

- LiveLink 面部捕捉支持

|

||||

- 角色相机添加了呼吸选项、更改角色相机的焦点位置功能。

|

||||

- 对应ControlRig不能很好应用的模型(PMX中骨骼层次不同的模型,使用半标准骨骼的模型)

|

||||

- 添加了一个工具来控制Sequence中的面部动画

|

||||

|

||||

## MToon材质

|

||||

默认材质设置为 Unlit,除此之外还是先PBR与SSS模式。

|

||||

|

||||

- 实现 MPC 材质集来调整材质参数

|

||||

- 自己实现ShaderMap以实现Unlit材质模型的投射阴影;可以设置第二个阴影颜色;修复可能无法绘制阴影的问题(没有MaterialSystem可以正常绘制阴影)

|

||||

- EyeAdaptation (对轮廓线部分使用了特殊的眼部自适应调整)

|

||||

- 实现 MatCap 上反射阴影

|

||||

- RimLight

|

||||

- UV Scroll

|

||||

- 启用生成 AO 阴影模型

|

||||

- MToonMaterialSystem 添加了 SSGI 切换选项

|

||||

- 启用以引用 LightRig 中的 DirectionalLightComponent(支持 SunSkyActor)。通过定向光到 Light Rig 的俯仰角添加了亮度校正选项。

|

||||

- 添加了一个参数来更改 FilmicTonemapper 逆变换的强度。从 MToonMaterialSystem 更改。

|

||||

- PostShadow 新增卡通功能

|

||||

- 注)M MoonLit 会根据场景稍微变暗。我决定不参考 SkyLight 来减少负载。要回到过去,请从材质中打开 bUseSkyLightDirect。

|

||||

- Rim light 和 matcap 不再受正常校正的影响

|

||||

|

||||

## VR相关

|

||||

- 在AnimBP中增加MotionController 和 Leap Motion 跟踪

|

||||

|

||||

## 官方上的支持功能

|

||||

您可以导入 VRM 文件

|

||||

- 动画片

|

||||

- 您可以轻松地重新定位。生成 A-pose / T-pose 和 BoneMap。

|

||||

- 面部动画(Morphtarget / BlendShapeGroup)可用。

|

||||

- 您可以为摆动骨骼选择 VRMSpringBone 或 PhysicsAsset。

|

||||

- 有一个通用的控制装置和一个用于操作的 UMG。

|

||||

- 您可以从外部应用程序接收动作捕捉数据。它支持 VMC 协议。

|

||||

- 您可以在运行时从 UEMannequin 重定向到 VRM 模型。

|

||||

- UE5:可以自动生成 IKRetargeter 资产。您可以从 Epic Skeleton 简化重定向过程。

|

||||

- 材料

|

||||

- 再现 M Moon 的素材。阴影颜色规格、轮廓颜色/粗细调整、MatCap 等都适用。

|

||||

- 您可以根据 PBR 背景切换和调整绘图模式。

|

||||

- 现有的后置滤镜和光线追踪可以同时使用。

|

||||

- 移动的

|

||||

- 配合BoneMap缩减功能,不用担心骨骼数量即可显示。

|

||||

- 您可以切换绘图质量。它支持低规格。

|

||||

- 虚拟现实/增强现实

|

||||

- 绘图同时支持 Forward / Deferred。

|

||||

- 由于它是由简单的函数组成的,所以它不会崩溃。

|

||||

- 运行时负载

|

||||

- 任何用户的 VRM 文件都可以从打包的 EXE 文件中读取。

|

||||

- 动画可以在运行时重新定位。

|

||||

- UE兼容性好

|

||||

- 导入后,它将是一个标准的骨架网格体资源。

|

||||

- 对应的UE版本是4.20~4.27,5.0(截至2022/04)很容易支持最新版本。

|

||||

- 依次支持VRM1.0β

|

||||

- VRM1.0数据在一定程度上可以导入。

|

||||

- 您可以保留本地轴或在导入时选择它。

|

||||

- 对应M Moon的新功能。

|

||||

- 实验实现

|

||||

235

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U与其他MMD插件笔记.md

Normal file

235

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U与其他MMD插件笔记.md

Normal file

@@ -0,0 +1,235 @@

|

||||

# Assimp入门

|

||||

https://assimp-docs.readthedocs.io/en/latest/about/introduction.html

|

||||

|

||||

# 其他卡通渲染推主

|

||||

https://twitter.com/rukikuri

|

||||

|

||||

# VRoid商城地址

|

||||

https://booth.pm/zh-cn

|

||||

|

||||

# VRM格式地址

|

||||

https://vrm.dev/

|

||||

## Unity3d导入插件

|

||||

导入https://github.com/vrm-c/UniVRM/releases

|

||||

导出Fbx插件:https://github.com/KellanHiggins/UnityFBXExporter

|

||||

|

||||

# VRM4U

|

||||

https://github.com/ruyo/UnrealEngine_VRM4UPlugin

|

||||

https://github.com/ruyo/VRM4U

|

||||

|

||||

## 渲染参考

|

||||

原文(上/下):

|

||||

https://qiita.com/ruyo/items/ec082d81dea3033e1500

|

||||

https://qiita.com/ruyo/items/71a3f2f694d2853b3f1e

|

||||

|

||||

光照:

|

||||

https://qiita.com/ruyo/items/28255f26725a6b6bd475

|

||||

|

||||

### 其他参考

|

||||

MToon:https://dwango.github.io/vrm/univrm/shaders/mtoon/

|

||||

Ue4中的卡通渲染:https://qiita.com/com04/items/a7895160df8d854fe924

|

||||

|

||||

## 曝光与ToneMapper问题解决

|

||||

ToneMapper与曝光会影响贴图的亮度,所以需要尝试干掉或者抵消掉他们的影响。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

手动去除了Gammer矫正以及ToneMapper取消,并且使用 人眼适应节点抵消曝光效果。

|

||||

|

||||

除此之外,还使用RayTracingQualitySwitchReplace节点与人眼适应节点做了Raytracing质量调整。(手机端为1)

|

||||

|

||||

## 阴影

|

||||

|

||||

使用了SceneCaptureComponent2D。

|

||||

在Orthographic(平行投影*)中,将CaptureSource设置为 "SceneDepth in R",TexrureTarget格式设置为 "RTF R32f"。

|

||||

这将导致深度在UnrealUnit中线性地写入缓冲区(默认为1=1cm)。 别紧张。

|

||||

|

||||

|

||||

要用Shadowmap投出一个阴影,你只需要知道从光线中看到的深度,以及投影矩阵的矩阵。

|

||||

我们会把这些东西找回来,传给材料。

|

||||

https://www.shibuya24.info/entry/shadowmap

|

||||

|

||||

官方的SceneCaptureComponent2D会做很多无用的渲染工作,推荐自己重新写一个,以减少不必要的消耗。

|

||||

|

||||

### 蓝图传递逆矩阵

|

||||

|

||||

在蓝图中国计算出SceneCaptureComponent2D的逆矩阵后,将其传入材质中。

|

||||

|

||||

|

||||

### 材质内

|

||||

在一个自定义节点中,将参数打包成float4x4,并进行计算。

|

||||

现在你可以从世界坐标中参考相应的影子图。

|

||||

在材料函数中,结果返回0-1。

|

||||

|

||||

|

||||

|

||||

## 描边

|

||||

在具体节点方面,

|

||||

投影结果 → TransformPosition节点转换为ViewSpace的转换结果

|

||||

Pixel Thickness → VectorLength的值。

|

||||

乘以倒数→部分除以VectorLength的值,再乘以反数→部分除以VectorLength的值。

|

||||

使用ScreenResolusion的原因是为了确保不影响窗口大小和宽高比。

|

||||

我不确定我是否准备好了......

|

||||

在MToon再现方面,我们需要能够选择 "恒定厚度模式 "和 "世界坐标参考模式"。

|

||||

|

||||

|

||||

http://historia.co.jp/archives/5587/

|

||||

|

||||

使用PoseableMeshComponent,与CopyPoseFromSkeletalComponent函数实现外描边。到时候比对一下这个方法与我的重定义图元方法的效率。

|

||||

|

||||

## 轮廓光

|

||||

使用MaterialCapture材质制作轮廓光。

|

||||

|

||||

## 光照模式

|

||||

默认的MToon为无光照模式(自定义光照效果)

|

||||

|

||||

其余的工作将通过增加材料参数来体现数值。 我就不说了,因为这样做是多余的。 (我没有评论了...)

|

||||

也可以应用ShadingShadingShift。

|

||||

|

||||

主源和GI可以通过在自定义节点中写出以下内容来获得。

|

||||

如果你用GetSkySHDiffuseSimple或GetSkySHDiffuse搜索usf文件,会有帮助。

|

||||

不要忘了在最终输出的SkyLight(ResolvedView.SkyLightColor.rgb)中乘以颜色。

|

||||

|

||||

```

|

||||

//主光源.usf

|

||||

return ResolvedView.DirectionalLightColor;

|

||||

```

|

||||

```

|

||||

//GIの影響.usf,然而这个是天光

|

||||

#if SIMPLE_FORWARD_SHADING

|

||||

float4 NormalVector = float4(Normal, 1);

|

||||

|

||||

float3 Intermediate0;

|

||||

Intermediate0.x = dot(View.SkyIrradianceEnvironmentMap[0], NormalVector);

|

||||

Intermediate0.y = dot(View.SkyIrradianceEnvironmentMap[1], NormalVector);

|

||||

Intermediate0.z = dot(View.SkyIrradianceEnvironmentMap[2], NormalVector);

|

||||

|

||||

// max to not get negative colors

|

||||

return max(0, Intermediate0) * ResolvedView.SkyLightColor.rgb;

|

||||

#else

|

||||

float4 NormalVector = float4(Normal, 1);

|

||||

|

||||

float3 Intermediate0, Intermediate1, Intermediate2;

|

||||

Intermediate0.x = dot(View.SkyIrradianceEnvironmentMap[0], NormalVector);

|

||||

Intermediate0.y = dot(View.SkyIrradianceEnvironmentMap[1], NormalVector);

|

||||

Intermediate0.z = dot(View.SkyIrradianceEnvironmentMap[2], NormalVector);

|

||||

|

||||

float4 vB = NormalVector.xyzz * NormalVector.yzzx;

|

||||

Intermediate1.x = dot(View.SkyIrradianceEnvironmentMap[3], vB);

|

||||

Intermediate1.y = dot(View.SkyIrradianceEnvironmentMap[4], vB);

|

||||

Intermediate1.z = dot(View.SkyIrradianceEnvironmentMap[5], vB);

|

||||

|

||||

float vC = NormalVector.x * NormalVector.x - NormalVector.y * NormalVector.y;

|

||||

Intermediate2 = View.SkyIrradianceEnvironmentMap[6].xyz * vC;

|

||||

|

||||

// max to not get negative colors

|

||||

return max(0, Intermediate0 + Intermediate1 + Intermediate2) * ResolvedView.SkyLightColor.rgb;

|

||||

#endif

|

||||

```

|

||||

## 其他光照模型

|

||||

|

||||

|

||||

## Runtime载入思路

|

||||

```

|

||||

NewObject<USkeletalMesh>()

|

||||

|

||||

SkeletalMesh->GetResourceForRendering()

|

||||

->LODRenderData[0]

|

||||

• StaticVertexBuffers

|

||||

顶点信息。 最起码,这将填补。

|

||||

• MultiSizeIndexContainer

|

||||

- 绘图时的顶点信息。 如果你要运行时加载的话,也要埋下这一点。

|

||||

- 从GameThread停止重写的成员从RenderThread重写。

|

||||

• SkeletalMesh->GetImportedModel()->LODModels[0].Sections;

|

||||

- 网格和材料信息。 我也要把这个埋了。

|

||||

• SkeletalMesh->RegisterMorphTarget()

|

||||

- 混合形状信息。 我也要把这个埋了。

|

||||

- UE4的顶点权重为uint8,所以有一个分数。 最后,正常化。

|

||||

```

|

||||

### VRM(glTF)转换时需要注意

|

||||

改变坐标系。

|

||||

- 转换为Z-up

|

||||

- 转换比例尺为虚幻单位(x100)

|

||||

- 支持多种根骨。

|

||||

- 去除不必要的骨头

|

||||

- 如果你不想移除的话,可以添加一个假根骨(root)。

|

||||

|

||||

字符与编码转换

|

||||

|

||||

### 物理资源导入

|

||||

```

|

||||

• bs = NewObject<USkeletalBodySetup>();

|

||||

• ct = NewObject<UPhysicsConstraintTemplate>();

|

||||

• physicsAsset->SkeletalBodySetups.Add(bs);

|

||||

• physicsAsset->ConstraintSetup.Add(ct);

|

||||

```

|

||||

我想让我的骨头不至于发狂。

|

||||

- 物理学变得很粗糙。 当碰撞被猛烈地掩埋时,就会引起注意。

|

||||

- 增加计算次数,会在一定程度上改善它。

|

||||

- 我想保持我想要的形状。

|

||||

- 我的头发因为地心引力而垂下来。

|

||||

- 可移动的范围可以指定,但移动不规范。 杂项:

|

||||

|

||||

VRMSpringBone是Unity的一个实现,目前已经发布了VRMSpringBone。

|

||||

- 理论上可以移植到UE4上。

|

||||

- 源码(VRMSpringBone.cs)只有329行。

|

||||

- 我不知道这样可以吗?

|

||||

|

||||

于是作者移植了VRMSpringBone。

|

||||

|

||||

我现在可以看VRM了。

|

||||

- 你现在可以导入/运行时加载

|

||||

- 我现在也能读出混合形状和碰撞了!

|

||||

- 现在,你可以重新创建VRMSpringBone

|

||||

- 你现在可以干扰UE4的碰撞了。

|

||||

|

||||

StaticMesh的运行时加载也是可能的。

|

||||

- 我可以创建一个自定义的摇摆骨质节点。

|

||||

- 对于那些对PhysicalAsset和AnimDynamics节点的行为不满意的人。

|

||||

- 你为什么不尝试着去做一个呢?

|

||||

|

||||

## 动画部分

|

||||

要想导入动画,可以使用

|

||||

|

||||

- (一) 骨架通用化

|

||||

- (二) 重新定位动画资产。

|

||||

|

||||

但两者都是编辑器功能,无法在runtime中使用。

|

||||

|

||||

### 使用AnimBP实现运行时重定向

|

||||

|

||||

将复制资产设置为AnimInstance,你就可以走了。

|

||||

|

||||

复制源头网状物。

|

||||

设置在编辑器中创建的AnimBP

|

||||

|

||||

要复制的网状物。

|

||||

设置VrmAnimInstanceCopy

|

||||

|

||||

# IM4U

|

||||

https://github.com/bm9/IM4U

|

||||

https://github.com/bm9/UnrealEngine_IM4UPlugin

|

||||

|

||||

# Blender和pmx2fbx

|

||||

|

||||

# Muro_CG

|

||||

使用Unity卡通着色的3D动画表达

|

||||

https://qiita.com/MuRo_CG/items/c417ef6d6cbeed3dd42b

|

||||

|

||||

Unity トゥーンシェーディングを使った3Dアニメ表現

|

||||

https://qiita.com/MuRo_CG/items/c417ef6d6cbeed3dd42b

|

||||

https://github.com/unity3d-jp/unitychan-crs

|

||||

|

||||

https://ja.whotwi.com/MuRo_CG/tweets/popular

|

||||

https://togetter.com/li/1438719

|

||||

|

||||

# Unity_Japan

|

||||

【Unite 2017 Tokyo】VR MAGIC! ~キャラクターに命を吹き込んだこの4年間の記録~

|

||||

https://www.slideshare.net/Unite2017Tokyo/unite-2017-tokyovr-magic4

|

||||

|

||||

https://www.youtube.com/watch?v=N4_x9w7wNNY&feature=youtu.be

|

||||

|

||||

# 米哈游

|

||||

http://www.uniteseoul.com/2018/download_files/T1_0503_2.pdf

|

||||

83

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U中资源带入逻辑与Assimp的使用.md

Normal file

83

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U中资源带入逻辑与Assimp的使用.md

Normal file

@@ -0,0 +1,83 @@

|

||||

## 自定义Asset

|

||||

https://zhuanlan.zhihu.com/p/77812246

|

||||

|

||||

- FAssetTypeActions_Base:是对已经创建好的资源操作函数的封装。这个资源在内容浏览器中的颜色,类型名字,显示的缩略图。

|

||||

- UFactory:这个是创建自定义类型文件的入口。以及创建资源的二级菜单。

|

||||

- UBlueprint: 创建继承类,来实现一个新的视图编辑窗口

|

||||

- UXXXX : Public Object : 这里面存储我们要编辑的数据

|

||||

|

||||

VRM中对应类为:

|

||||

- FAssetTypeActions_VrmAssetList、UVrmAssetListThumbnailRenderer

|

||||

- UVRM4UImporterFactory

|

||||

- UVrmAssetListObject

|

||||

|

||||

## Assimp

|

||||

资源工厂类中:UVRM4UImporterFactory::FactoryCreateBinary

|

||||

```

|

||||

{

|

||||

const UVrmRuntimeSettings* Settings = GetDefault<UVrmRuntimeSettings>();

|

||||

|

||||

{

|

||||

FSoftObjectPath r = Settings->AssetListObject; //(TEXT("/VRM4U/VrmObjectListBP.VrmObjectListBP"));

|

||||

UObject *u = r.TryLoad();

|

||||

if (u) {

|

||||

if (Cast<UBlueprint>(u)) {

|

||||

c = (UClass*)(Cast<UBlueprint>(u)->GeneratedClass);

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

if (c == nullptr) {

|

||||

FSoftObjectPath r(TEXT("/VRM4U/VrmAssetListObjectBP.VrmAssetListObjectBP"));

|

||||

UObject *u = r.TryLoad();

|

||||

if (u) {

|

||||

c = (UClass*)(Cast<UBlueprint>(u)->GeneratedClass);

|

||||

}

|

||||

}

|

||||

|

||||

if (c == nullptr) {

|

||||

c = UVrmAssetListObject::StaticClass();

|

||||

}

|

||||

|

||||

m = NewObject<UVrmAssetListObject>((UObject*)GetTransientPackage(), c.Get());

|

||||

}

|

||||

|

||||

UVrmAssetListObject* mret = nullptr;

|

||||

if (m) {

|

||||

//auto a = NewObject<UVrmAssetListObject>(MatClass.Object, NAME_None, RF_Transactional);

|

||||

//MatClass.Object;

|

||||

//ULoaderBPFunctionLibrary::LoadVRMFile(nullptr, fullFileName);

|

||||

|

||||

GWarn->BeginSlowTask( NSLOCTEXT("UnrealEd", "ImportVRM", "Importing VRM"), true );

|

||||

|

||||

int ret = true;

|

||||

auto &g = VRMConverter::Options::Get();

|

||||

g.SetVrmOption(ImportUI->GenerateOptionData());

|

||||

|

||||

ULoaderBPFunctionLibrary::SetImportMode(true, Cast<UPackage>(InParent));

|

||||

{

|

||||

ret = ULoaderBPFunctionLibrary::LoadVRMFileLocal(m.Get(), mret, fullFileName);

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

蓝图函数库中:bool ULoaderBPFunctionLibrary::LoadVRMFileFromMemory()。

|

||||

```

|

||||

Assimp::Importer mImporter;

|

||||

const aiScene* mScenePtr = nullptr; // delete by Assimp::Importer::~Importer

|

||||

|

||||

mScenePtr = mImporter.ReadFileFromMemory(pFileDataData, dataSize,

|

||||

aiProcess_Triangulate | aiProcess_MakeLeftHanded | aiProcess_CalcTangentSpace | aiProcess_GenSmoothNormals | aiProcess_OptimizeMeshes,

|

||||

e.c_str());

|

||||

|

||||

if (mScenePtr == nullptr) {

|

||||

std::string file;

|

||||

file = utf_16_to_shift_jis(*filepath);

|

||||

|

||||

mScenePtr = mImporter.ReadFile(file, aiProcess_Triangulate | aiProcess_MakeLeftHanded | aiProcess_CalcTangentSpace | aiProcess_GenSmoothNormals | aiProcess_OptimizeMeshes);

|

||||

}

|

||||

```

|

||||

271

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U卡通渲染实现.md

Normal file

271

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U卡通渲染实现.md

Normal file

@@ -0,0 +1,271 @@

|

||||

# Assimp入门

|

||||

https://assimp-docs.readthedocs.io/en/latest/about/introduction.html

|

||||

|

||||

# 其他卡通渲染推主

|

||||

https://twitter.com/rukikuri

|

||||

|

||||

# VRM格式地址

|

||||

https://vrm.dev/

|

||||

## Unity3d导入插件

|

||||

导入https://github.com/vrm-c/UniVRM/releases

|

||||

导出Fbx插件:https://github.com/KellanHiggins/UnityFBXExporter

|

||||

|

||||

# VRM4U

|

||||

https://github.com/ruyo/UnrealEngine_VRM4UPlugin

|

||||

https://github.com/ruyo/VRM4U

|

||||

|

||||

## 渲染原理介绍

|

||||

原文(上/下):

|

||||

https://qiita.com/ruyo/items/ec082d81dea3033e1500

|

||||

https://qiita.com/ruyo/items/71a3f2f694d2853b3f1e

|

||||

|

||||

MToon:https://dwango.github.io/vrm/univrm/shaders/mtoon/

|

||||

Ue4中的卡通渲染:https://qiita.com/com04/items/a7895160df8d854fe924

|

||||

|

||||

材质:

|

||||

https://qiita.com/ruyo/items/ddf727e9fa81a24070fb (细节都在这里)

|

||||

https://qiita.com/ruyo/items/28255f26725a6b6bd475

|

||||

|

||||

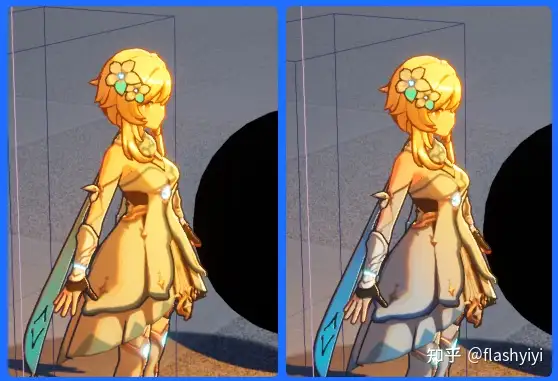

Unlit

|

||||

|

||||

|

||||

|

||||

PBR

|

||||

|

||||

|

||||

|

||||

SSS

|

||||

|

||||

|

||||

|

||||

## 灯光调整

|

||||

|

||||

|

||||

2种方法:

|

||||

- 开启天光的LowerHemisphereIsSolidColor,但这样会场景效果变得有些奇怪

|

||||

- 添加一个从下往上的方向光

|

||||

|

||||

使用这个方法 以及 PBR材质中的BaseColor与Emissive进行插值来接近HalfLambda的效果。

|

||||

|

||||

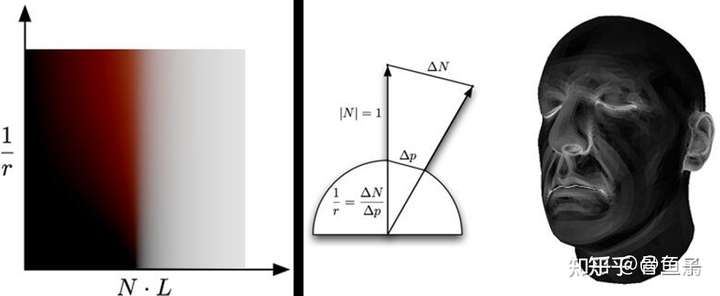

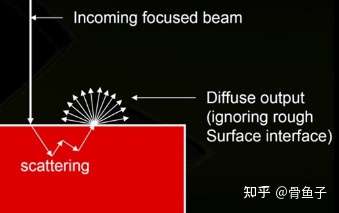

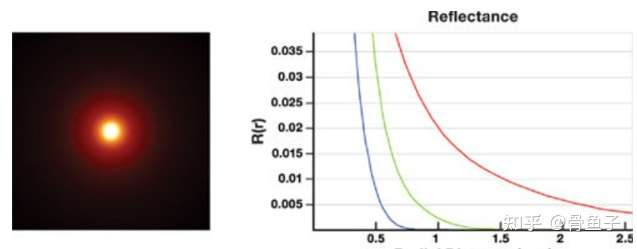

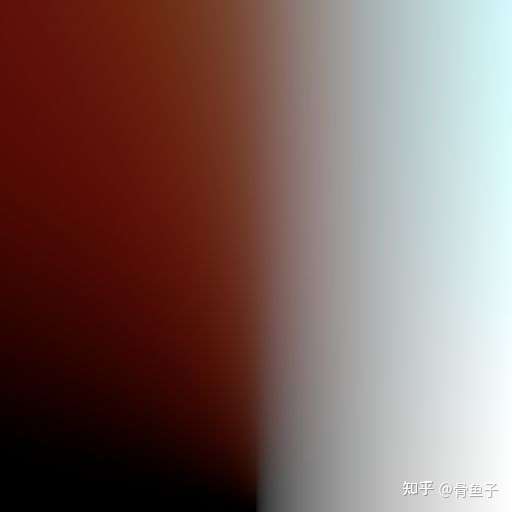

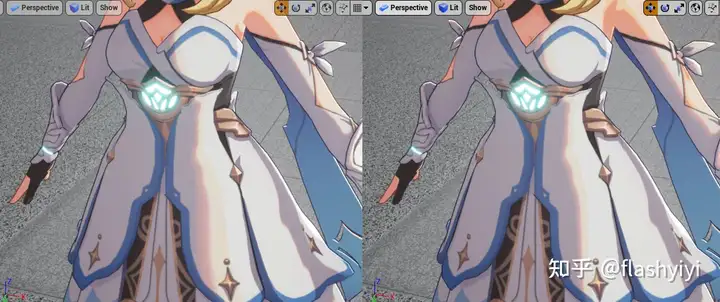

## 调整面部法线来柔化面部阴影

|

||||

|

||||

|

||||

|

||||

## 曝光与ToneMapper问题解决

|

||||

ToneMapper与曝光会影响贴图的亮度,所以需要尝试干掉或者抵消掉他们的影响。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

手动去除了Gammer矫正以及ToneMapper取消,并且使用 人眼适应节点抵消曝光效果。

|

||||

|

||||

除此之外,还使用RayTracingQualitySwitchReplace节点与人眼适应节点做了Raytracing质量调整。(手机端为1)

|

||||

|

||||

## 阴影

|

||||

|

||||

使用了SceneCaptureComponent2D。

|

||||

在Orthographic(平行投影*)中,将CaptureSource设置为 "SceneDepth in R",TexrureTarget格式设置为 "RTF R32f"。

|

||||

这将导致深度在UnrealUnit中线性地写入缓冲区(默认为1=1cm)。 别紧张。

|

||||

|

||||

|

||||

要用Shadowmap投出一个阴影,你只需要知道从光线中看到的深度,以及投影矩阵的矩阵。

|

||||

我们会把这些东西找回来,传给材料。

|

||||

https://www.shibuya24.info/entry/shadowmap

|

||||

|

||||

官方的SceneCaptureComponent2D会做很多无用的渲染工作,推荐自己重新写一个,以减少不必要的消耗。

|

||||

|

||||

### 蓝图传递逆矩阵

|

||||

|

||||

在蓝图中国计算出SceneCaptureComponent2D的逆矩阵后,将其传入材质中。

|

||||

|

||||

|

||||

### 材质内

|

||||

在一个自定义节点中,将参数打包成float4x4,并进行计算。

|

||||

现在你可以从世界坐标中参考相应的影子图。

|

||||

在材料函数中,结果返回0-1。

|

||||

|

||||

|

||||

|

||||

## 描边

|

||||

在具体节点方面,

|

||||

投影结果 → TransformPosition节点转换为ViewSpace的转换结果

|

||||

Pixel Thickness → VectorLength的值。

|

||||

乘以倒数→部分除以VectorLength的值,再乘以反数→部分除以VectorLength的值。

|

||||

使用ScreenResolusion的原因是为了确保不影响窗口大小和宽高比。

|

||||

我不确定我是否准备好了......

|

||||

在MToon再现方面,我们需要能够选择 "恒定厚度模式 "和 "世界坐标参考模式"。

|

||||

|

||||

|

||||

http://historia.co.jp/archives/5587/

|

||||

|

||||

使用PoseableMeshComponent,与CopyPoseFromSkeletalComponent函数实现外描边。到时候比对一下这个方法与我的重定义图元方法的效率。

|

||||

|

||||

## 轮廓光

|

||||

使用MaterialCapture材质制作轮廓光。

|

||||

|

||||

## 光照模式

|

||||

默认的MToon为无光照模式(自定义光照效果)

|

||||

|

||||

其余的工作将通过增加材料参数来体现数值。 我就不说了,因为这样做是多余的。 (我没有评论了...)

|

||||

也可以应用ShadingShadingShift。

|

||||

|

||||

主源和GI可以通过在自定义节点中写出以下内容来获得。

|

||||

如果你用GetSkySHDiffuseSimple或GetSkySHDiffuse搜索usf文件,会有帮助。

|

||||

不要忘了在最终输出的SkyLight(ResolvedView.SkyLightColor.rgb)中乘以颜色。

|

||||

|

||||

```

|

||||

//主光源.usf

|

||||

return ResolvedView.DirectionalLightColor;

|

||||

```

|

||||

```

|

||||

//GIの影響.usf,然而这个是天光

|

||||

#if SIMPLE_FORWARD_SHADING

|

||||

float4 NormalVector = float4(Normal, 1);

|

||||

|

||||

float3 Intermediate0;

|

||||

Intermediate0.x = dot(View.SkyIrradianceEnvironmentMap[0], NormalVector);

|

||||

Intermediate0.y = dot(View.SkyIrradianceEnvironmentMap[1], NormalVector);

|

||||

Intermediate0.z = dot(View.SkyIrradianceEnvironmentMap[2], NormalVector);

|

||||

|

||||

// max to not get negative colors

|

||||

return max(0, Intermediate0) * ResolvedView.SkyLightColor.rgb;

|

||||

#else

|

||||

float4 NormalVector = float4(Normal, 1);

|

||||

|

||||

float3 Intermediate0, Intermediate1, Intermediate2;

|

||||

Intermediate0.x = dot(View.SkyIrradianceEnvironmentMap[0], NormalVector);

|

||||

Intermediate0.y = dot(View.SkyIrradianceEnvironmentMap[1], NormalVector);

|

||||

Intermediate0.z = dot(View.SkyIrradianceEnvironmentMap[2], NormalVector);

|

||||

|

||||

float4 vB = NormalVector.xyzz * NormalVector.yzzx;

|

||||

Intermediate1.x = dot(View.SkyIrradianceEnvironmentMap[3], vB);

|

||||

Intermediate1.y = dot(View.SkyIrradianceEnvironmentMap[4], vB);

|

||||

Intermediate1.z = dot(View.SkyIrradianceEnvironmentMap[5], vB);

|

||||

|

||||

float vC = NormalVector.x * NormalVector.x - NormalVector.y * NormalVector.y;

|

||||

Intermediate2 = View.SkyIrradianceEnvironmentMap[6].xyz * vC;

|

||||

|

||||

// max to not get negative colors

|

||||

return max(0, Intermediate0 + Intermediate1 + Intermediate2) * ResolvedView.SkyLightColor.rgb;

|

||||

#endif

|

||||

```

|

||||

## 其他光照模型

|

||||

|

||||

|

||||

## Runtime载入思路

|

||||

```

|

||||

NewObject<USkeletalMesh>()

|

||||

|

||||

SkeletalMesh->GetResourceForRendering()

|

||||

->LODRenderData[0]

|

||||

• StaticVertexBuffers

|

||||

顶点信息。 最起码,这将填补。

|

||||

• MultiSizeIndexContainer

|

||||

- 绘图时的顶点信息。 如果你要运行时加载的话,也要埋下这一点。

|

||||

- 从GameThread停止重写的成员从RenderThread重写。

|

||||

• SkeletalMesh->GetImportedModel()->LODModels[0].Sections;

|

||||

- 网格和材料信息。 我也要把这个埋了。

|

||||

• SkeletalMesh->RegisterMorphTarget()

|

||||

- 混合形状信息。 我也要把这个埋了。

|

||||

- UE4的顶点权重为uint8,所以有一个分数。 最后,正常化。

|

||||

```

|

||||

### VRM(glTF)转换时需要注意

|

||||

改变坐标系。

|

||||

- 转换为Z-up

|

||||

- 转换比例尺为虚幻单位(x100)

|

||||

- 支持多种根骨。

|

||||

- 去除不必要的骨头

|

||||

- 如果你不想移除的话,可以添加一个假根骨(root)。

|

||||

|

||||

字符与编码转换

|

||||

|

||||

### 物理资源导入

|

||||

```

|

||||

• bs = NewObject<USkeletalBodySetup>();

|

||||

• ct = NewObject<UPhysicsConstraintTemplate>();

|

||||

• physicsAsset->SkeletalBodySetups.Add(bs);

|

||||

• physicsAsset->ConstraintSetup.Add(ct);

|

||||

```

|

||||

我想让我的骨头不至于发狂。

|

||||

- 物理学变得很粗糙。 当碰撞被猛烈地掩埋时,就会引起注意。

|

||||

- 增加计算次数,会在一定程度上改善它。

|

||||

- 我想保持我想要的形状。

|

||||

- 我的头发因为地心引力而垂下来。

|

||||

- 可移动的范围可以指定,但移动不规范。 杂项:

|

||||

|

||||

VRMSpringBone是Unity的一个实现,目前已经发布了VRMSpringBone。

|

||||

- 理论上可以移植到UE4上。

|

||||

- 源码(VRMSpringBone.cs)只有329行。

|

||||

- 我不知道这样可以吗?

|

||||

|

||||

于是作者移植了VRMSpringBone。

|

||||

|

||||

我现在可以看VRM了。

|

||||

- 你现在可以导入/运行时加载

|

||||

- 我现在也能读出混合形状和碰撞了!

|

||||

- 现在,你可以重新创建VRMSpringBone

|

||||

- 你现在可以干扰UE4的碰撞了。

|

||||

|

||||

StaticMesh的运行时加载也是可能的。

|

||||

- 我可以创建一个自定义的摇摆骨质节点。

|

||||

- 对于那些对PhysicalAsset和AnimDynamics节点的行为不满意的人。

|

||||

- 你为什么不尝试着去做一个呢?

|

||||

|

||||

## 动画部分

|

||||

要想导入动画,可以使用

|

||||

|

||||

- (一) 骨架通用化

|

||||

- (二) 重新定位动画资产。

|

||||

|

||||

但两者都是编辑器功能,无法在runtime中使用。

|

||||

|

||||

### 使用AnimBP实现运行时重定向

|

||||

|

||||

将复制资产设置为AnimInstance,你就可以走了。

|

||||

|

||||

复制源头网状物。

|

||||

设置在编辑器中创建的AnimBP

|

||||

|

||||

要复制的网状物。

|

||||

设置VrmAnimInstanceCopy

|

||||

|

||||

# IM4U

|

||||

https://github.com/bm9/IM4U

|

||||

https://github.com/bm9/UnrealEngine_IM4UPlugin

|

||||

|

||||

# Blender和pmx2fbx

|

||||

|

||||

## U3d日本分部分项

|

||||

|

||||

『崩壊3rd』開発者が語るアニメ風レンダリングの極意

|

||||

ユニティちゃんトゥーンシェーダー2.0使いこなしスペシャル ~こだわりの活用法を紹介します!~

|

||||

|

||||

〈七つの大罪〉をゲームで! 高品質グラフィックを具現化するための技法と開発最適化のご紹介 by Jaeseong Ryu 他

|

||||

|

||||

|

||||

# Muro_CG

|

||||

使用Unity卡通着色的3D动画表达

|

||||

https://qiita.com/MuRo_CG/items/c417ef6d6cbeed3dd42b

|

||||

|

||||

Unity トゥーンシェーディングを使った3Dアニメ表現

|

||||

https://qiita.com/MuRo_CG/items/c417ef6d6cbeed3dd42b

|

||||

https://github.com/unity3d-jp/unitychan-crs

|

||||

|

||||

https://ja.whotwi.com/MuRo_CG/tweets/popular

|

||||

https://togetter.com/li/1438719

|

||||

|

||||

# Unity_Japan

|

||||

【Unite 2017 Tokyo】VR MAGIC! ~キャラクターに命を吹き込んだこの4年間の記録~

|

||||

https://www.slideshare.net/Unite2017Tokyo/unite-2017-tokyovr-magic4

|

||||

|

||||

https://www.youtube.com/watch?v=N4_x9w7wNNY&feature=youtu.be

|

||||

|

||||

# 米哈游

|

||||

http://www.uniteseoul.com/2018/download_files/T1_0503_2.pdf

|

||||

|

||||

|

||||

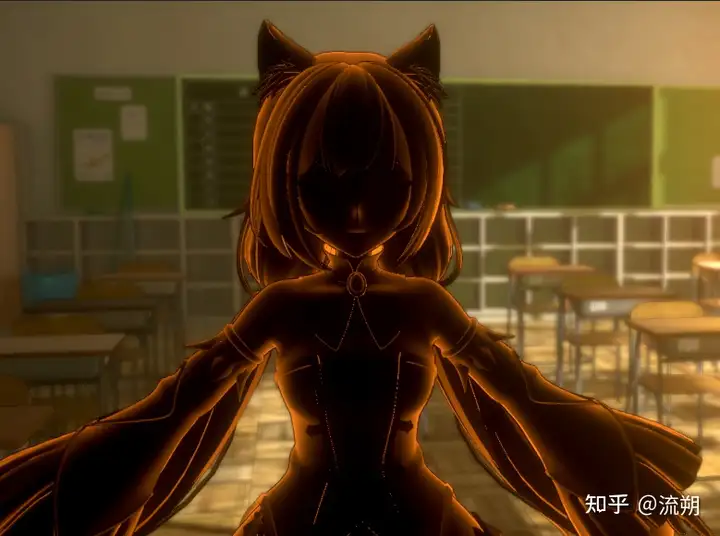

米哈游面部阴影实现:

|

||||

Improved Alpha-Tested Magnification for Vector Textures and Special Effects

|

||||

|

||||

https://steamcdn-a.akamaihd.net/apps/valve/2007/SIGGRAPH2007_AlphaTestedMagnification.pdf

|

||||

BIN

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U技术讲解.pdf

Normal file

BIN

03-UnrealEngine/卡通渲染相关资料/VRM4U/VRM4U技术讲解.pdf

Normal file

Binary file not shown.

445

03-UnrealEngine/卡通渲染相关资料/卡通渲染实现笔记.md

Normal file

445

03-UnrealEngine/卡通渲染相关资料/卡通渲染实现笔记.md

Normal file

@@ -0,0 +1,445 @@

|

||||

# 实用库

|

||||

`#include "/Engine/Private/Random.ush"`

|

||||

`#include "/Engine/Private/SobolRandom.ush"`

|

||||

|

||||

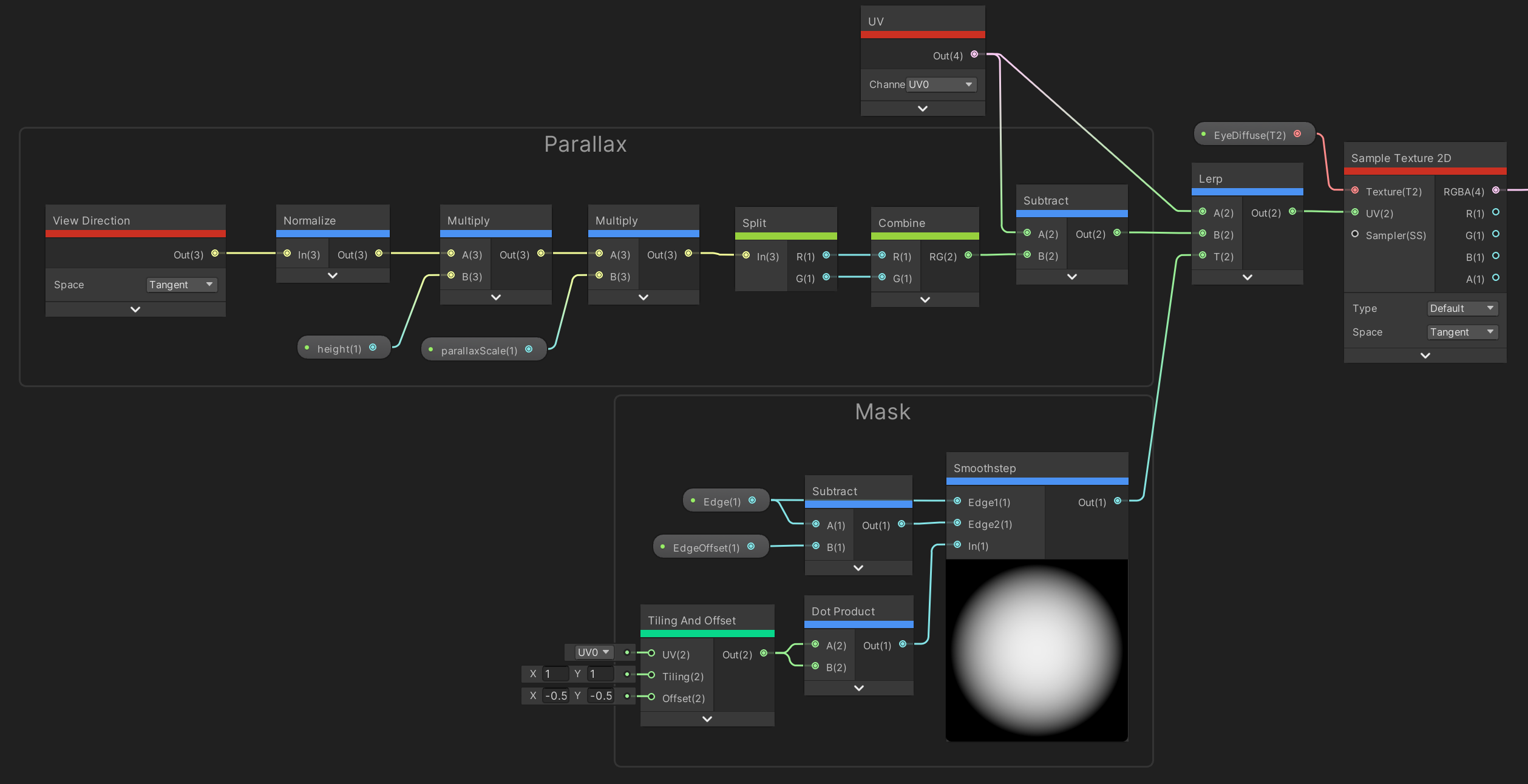

# 眼睛

|

||||

眼睛焦散:

|

||||

|

||||

## 凹模型

|

||||

直接贴图即可。

|

||||

折射

|

||||

模型高光

|

||||

|

||||

## 凸模型

|

||||

1. 使用视差贴图来控制瞳孔效果 + 折射模拟

|

||||

```

|

||||

float2 viewL = mul(viewW, (float3x2) worldInverse);

|

||||

float2 offset = height * viewL;

|

||||

offset.y = -offset.y;

|

||||

texcoord -= parallaxScale * offset;

|

||||

```

|

||||

|

||||

|

||||

2. Physically based refraction

|

||||

```c++

|

||||

// 角膜区域突起的模型

|

||||

// Alternatively, use a displacement map

|

||||

// height = max(-positionL.z – eyeIrisDepth, 0.0);

|

||||

|

||||

// 球形模型

|

||||

// Plot[Max[1.0 - 18.4 * r * r, 0.0], {r, 0, 0.3}]

|

||||

height = anteriorChamberDepth * saturate( 1.0 - 18.4 * radius * radius );

|

||||

|

||||

// refractedW

|

||||

float w = n * dot( normalW, viewW );

|

||||

float k = sqrt( 1.0 + ( w - n ) * ( w + n ) );

|

||||

float3 refractedW = ( w - k ) * normalW - n * viewW;

|

||||

|

||||

float cosAlpha = dot(frontNormalW, -refractedW);

|

||||

float dist = height / cosAlpha;

|

||||

float3 offsetW = dist * refractedW;

|

||||

float2 offsetL = mul(offsetW, (float3x2) worldInverse);

|

||||

texcoord += float2(mask, -mask) * offsetL;

|

||||

```

|

||||

|

||||

|

||||

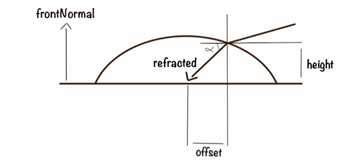

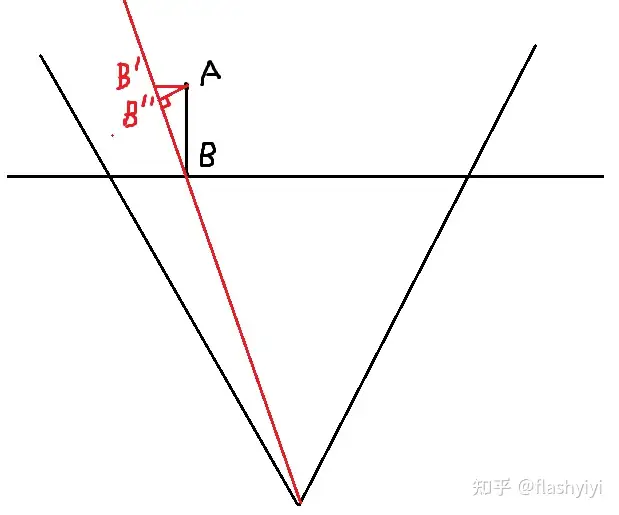

代码中首先计算了height,即前房的高度,PPT中height有两种计算方式,分别对应两种眼睛的模型结构,对应的结构写在注释中了。

|

||||

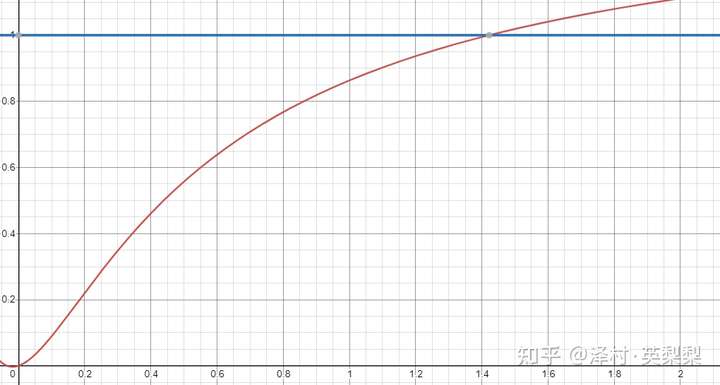

然后计算了refracted,这个是rtr中快速拟合的计算方法,n是空气与介质折射率的比值,关于refracted的推论可以参考:

|

||||

YivanLee:虚幻4渲染编程(人物篇)【第三卷:Human Eye Rendering】

|

||||

[129 赞同 · 12 评论文章](https://zhuanlan.zhihu.com/p/151786832)

|

||||

|

||||

最后一段,先通过frontNormalW与refractedW的点积计算出α角的cos值(上图中的α应该是标识错误,α是-refractedW与frontNormalW的夹角)。然后已知height,通过比值可以计算出refractedW的模长dist。offsetW即为完整的refractedW向量。最后转换到本地空间,乘上眼睛的Mask,加到原本的UV上。

|

||||

之后就是使用偏转后的UV去采样贴图了。

|

||||

与视差相同,这里也是在本地与世界空间中进行的计算,同样会有轴向问题,主要是normalW、viewW和frontNormalW参与的计算,normal与view可以转换到切线空间计算,而frontNormalW代表的是模型向前的朝向,这个必须要指定,不过图方便的话,把frontNormalW改成切线空间法线也不是不可以。

|

||||

|

||||

### 多层复合模型

|

||||

樱花大战cedec2020分享:https://blog.ch-wind.com/cedec2020-new-sakura-wars-note/

|

||||

|

||||

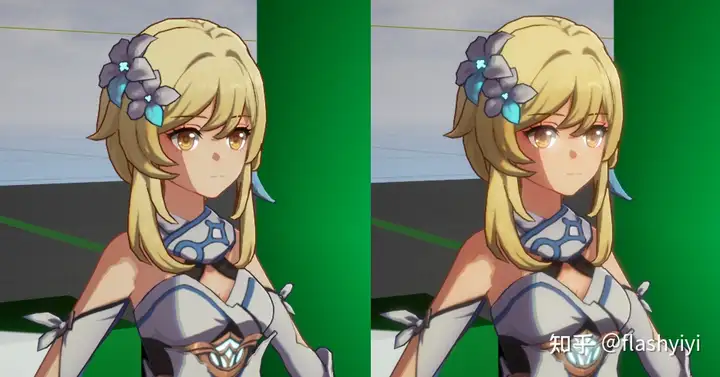

>本作的眼睛分为三个部分,眼白的部分是一个内凹的形状,瞳孔的部分则分为了向内凹的部分和向外突出的部分。

|

||||

|

||||

|

||||

>瞳孔的高光叠加在其突出的半透明部分上。根据摄像角度的不同,各个部分的贴图会分开进行移动,使得在哪个角度高光都能处在一个刚好的位置。

|

||||

控制上,有针对高光上下左右的移动强度与控制移动范围的参数共同作用。

|

||||

|

||||

|

||||

>从左边开始,是作为基础颜色的Albedo,以及用于Mask瞳孔的Alpha贴图,用于在Albedo上进行叠加的spt贴图,以及两张瞳孔高光,以及反应环境的matcapture贴图。

|

||||

虽然很多动画风格的渲染中会省略掉瞳孔中的虹彩部分,但是本作为了提高角色靠近时的效果,进行了详细的绘制,同时为了体现环境的变化与matcap的贴图进行叠加。

|

||||

高光贴图有两张,分别使用不同的UV动画进行控制,用于表现眼睛的湿润感。虽然是很细微的操作,但是对于表现角色的感情非常的有用。

|

||||

|

||||

|

||||

SunnySideUp UnityChan

|

||||

|

||||

### 其他效果实现

|

||||

#### 眼睛高光效果

|

||||

1. 贴图高光。使用事先绘制的高光形状贴图,贴到最外面的。并且使用ViewDirection来控制。设定4个UV Coord, 根据 View=》眼睛的本地坐标系=》Normalize后的向量进行插值。

|

||||

2. ~~PBR的思路~~

|

||||

|

||||

#### Matcap反射效果

|

||||

Matcap材质+球形法线贴图

|

||||

```c++

|

||||

float3 NormalBlend_MatcapUV_Detail = viewNormal.rgb * float3(-1,-1,1);

|

||||

float3 NormalBlend_MatcapUV_Base = (mul( UNITY_MATRIX_V, float4(viewDirection,0)).rgb*float3(-1,-1,1)) + float3(0,0,1);

|

||||

float3 noSknewViewNormal = NormalBlend_MatcapUV_Base * dot(NormalBlend_MatcapUV_Base, NormalBlend_MatcapUV_Detail) / NormalBlend_MatcapUV_Base.b - NormalBlend_MatcapUV_Detail;

|

||||

float2 ViewNormalAsMatCapUV = noSknewViewNormal.rg * 0.5 + 0.5;

|

||||

```

|

||||

|

||||

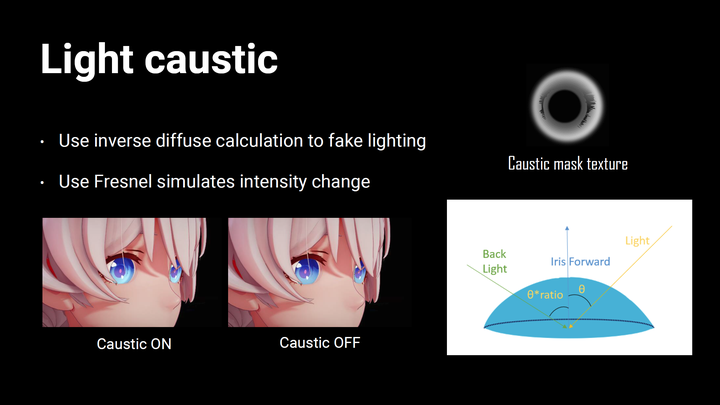

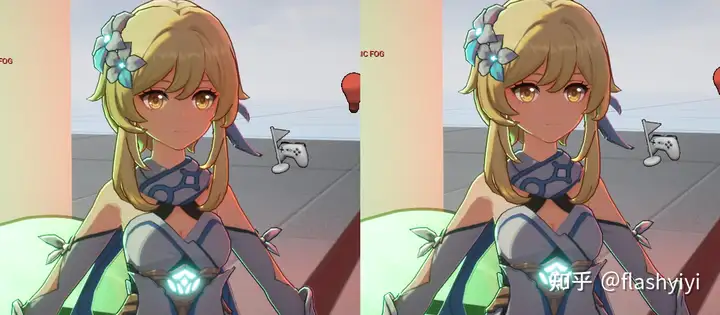

#### 焦散效果

|

||||

>焦散的表现反倒简单了,直接画在眼睛贴图上都可以,考虑到卡通表达的自由性,焦散是否存在与焦散的形状都可以没有限制,只要好看就行。

|

||||

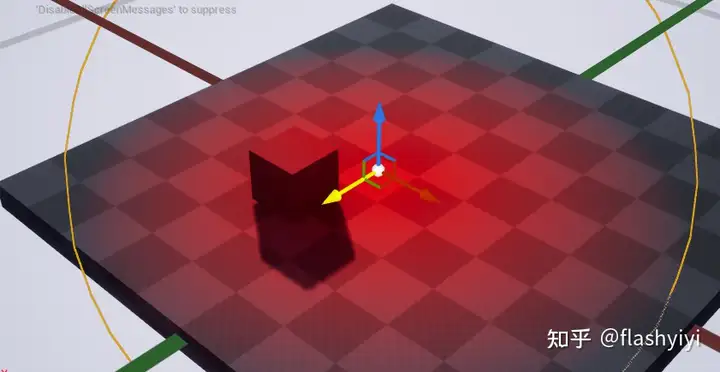

下图也是miHoYo的分享,可以简单的理解为直接贴张Mask上去,然后用光照方向和菲涅尔去影响强度变化。

|

||||

|

||||

|

||||

使用Mask贴图、NoL与菲尼尔来控制

|

||||

|

||||

# 其他游戏方案

|

||||

* [蓝色协议](/document/UrealEngineNPR渲染实现/蓝色协议的方案.html)

|

||||

|

||||

# 大致方案

|

||||

- 主要分为在材质编辑器中完成大部分渲染

|

||||

- 传递少量参数到Lighting阶段并进行光照计算

|

||||

- 以上两者结合

|

||||

|

||||

## 待实现功能

|

||||

- [ ] 顶点色控制Outline宽度,使用顶点色G。

|

||||

- [ ] 使用[罪恶装备中的lightmap](#lightmap) 控制高光的区域和阈值,包括顶点色可以精准控制高光的强度。

|

||||

|

||||

## 具体实现

|

||||

### 全局设置实现

|

||||

AWorldSettings存储于ULevel中。可以通过Project Settings->Engine->General Settings->Default Classes来修改成其他的类作为默认类。

|

||||

```c#

|

||||

[/Script/Engine.Engine]

|

||||

WorldSettingsClassName=/Script/MySpiffyGame.MySpiffyGameWorldSettings

|

||||

```

|

||||

C++中修改Settings类:`void ULevel::SetWorldSettings(AWorldSettings* NewWorldSettings)`或许可以考虑子系统。

|

||||

|

||||

### Shader与管线变量添加

|

||||

```c#

|

||||

shadowAttenuation = mainLight.shadowAttenuation;

|

||||

|

||||

float _SystemShadowsLevel_var = (shadowAttenuation*0.5)+0.5+_Tweak_SystemShadowsLevel > 0.001 ? (shadowAttenuation*0.5)+0.5+_Tweak_SystemShadowsLevel : 0.0001;

|

||||

float Set_FinalShadowMask = saturate((1.0 + ( (lerp( _HalfLambert_var, _HalfLambert_var*saturate(_SystemShadowsLevel_var), _Set_SystemShadowsToBase ) - (_BaseColor_Step-_BaseShade_Feather)) * ((1.0 - _Set_1st_ShadePosition_var.rgb).r - 1.0) ) / (_BaseColor_Step - (_BaseColor_Step-_BaseShade_Feather))));

|

||||

```

|

||||

|

||||

Ramp相关变量

|

||||

- shadowAttenuation 默认为1(方向光没有这个参数)与 Tweak_SystemShadowsLevel,先暂时合并为HalfLambertFix

|

||||

- Step

|

||||

- Feather

|

||||

|

||||

|

||||

Shader开关变量

|

||||

- Is_LightColor_BaseColor:BaseColor是否受到LightColor影响

|

||||

- Is_LightColor_ShadeColor:1st_ShadeColor是否受到LightColor影响

|

||||

|

||||

FViewUniformShaderParameter添加数据

|

||||

-

|

||||

### 顶点色

|

||||

用于存储一些低精度数据,插值即可

|

||||

- R:

|

||||

- G:描边宽度

|

||||

- B:

|

||||

|

||||

蓝色协议的R:阴影区域标记 与 B:Ao,而罪恶装备使用贴图来传递信息。

|

||||

|

||||

### lightmap

|

||||

,G为阴影控(AO),R为高光强度参数,金属和光滑材质的部分设置的更大一些。B通道:用于照明控制。最大值为高光,反之,值越小高光越淡。

|

||||

|

||||

|

||||

https://zhuanlan.zhihu.com/p/360229590一文中介绍了崩坏3与原神的计算方式

|

||||

|

||||

崩坏3的LightMap计算方式:

|

||||

```c++

|

||||

half4 baseColor = SAMPLE_TEXTURE2D(_BaseMap, sampler_BaseMap, input.uv.xy);

|

||||

half4 LightMapColor = SAMPLE_TEXTURE2D(_LightMap, sampler_LightMap, input.uv.xy);

|

||||

half3 ShadowColor = baseColor.rgb * _ShadowMultColor.rgb;

|

||||

half3 DarkShadowColor = baseColor.rgb * _DarkShadowMultColor.rgb;

|

||||

|

||||

//如果SFactor = 0,ShallowShadowColor为一级阴影色,否则为BaseColor。

|

||||

float SWeight = (LightMapColor.g * input.color.r + input.lambert) * 0.5 + 1.125;

|

||||

float SFactor = floor(SWeight - _ShadowArea);

|

||||

half3 ShallowShadowColor = SFactor * baseColor.rgb + (1 - SFactor) * ShadowColor.rgb;

|

||||

```

|

||||

|

||||

二级阴影计算:

|

||||

```c++

|

||||

//如果SFactor = 0,DarkShadowColor为二级阴影色,否则为一级阴影色。

|

||||

SFactor = floor(SWeight - _DarkShadowArea);

|

||||

DarkShadowColor = SFactor * (_FixDarkShadow * ShadowColor + (1 - _FixDarkShadow) * ShallowShadowColor) + (1 - SFactor) * DarkShadowColor;

|

||||

|

||||

// 平滑阴影边缘

|

||||

half rampS = smoothstep(0, _ShadowSmooth, input.lambert - _ShadowArea);

|

||||

half rampDS = smoothstep(0, _DarkShadowSmooth, input.lambert - _DarkShadowArea);

|

||||

ShallowShadowColor.rgb = lerp(ShadowColor, baseColor.rgb, rampS);

|

||||

DarkShadowColor.rgb = lerp(DarkShadowColor.rgb, ShadowColor, rampDS);

|

||||

|

||||

//如果SFactor = 0,FinalColor为二级阴影,否则为一级阴影。

|

||||

SFactor = floor(LightMapColor.g * input.color.r + 0.9f);

|

||||

half4 FinalColor;

|

||||

FinalColor.rgb = SFactor * ShallowShadowColor + (1 - SFactor) * DarkShadowColor;

|

||||

```

|

||||